Moderne AI-beeldgeneratoren ontwikkelen zich snel, en de gebreken die in de begintijd in één oogopslag zichtbaar waren, zoals vervormde handen en voeten, rommelige tekst en vreemde beeldruis, worden geleidelijk met technische middelen gladgestreken. Tegenwoordig zijn veel synthetische beelden voldoende om de blote ogen van gewone mensen te misleiden en zich ongecontroleerd op sociale media te verspreiden. Een studie gepubliceerd in het tijdschrift Science wijst er echter op dat deze modellen in wezen nog steeds ‘niet begrijpen’ hoe licht en geometrie in de echte wereld werken, en dat natuurwetten een van de meest betrouwbare hulpmiddelen worden voor het identificeren van authentieke en nepbeelden.

Onderzoekers wezen erop dat zolang de reflectie, schaduw, perspectieflijn en andere schijnbaar triviale delen worden gemeten, er nog steeds een kans is om een schijnbaar perfecte AI-foto te onthullen. Deze verificatiemethode, gebaseerd op de consistentie van de fysieke wereld, wordt door deskundigen op het gebied van digitaal forensisch onderzoek beschouwd als een belangrijke verdedigingslinie bij het onderscheiden van echte foto’s van AI-vervalsingen in het tijdperk van ‘deep fakes’. Vroege identificatie was vaak afhankelijk van het blote oog om grove technische tekortkomingen vast te leggen, maar naarmate de kwaliteit van de productie verbeterde, begonnen de beelden zich steeds meer te conformeren aan de menselijke subjectieve verwachtingen van de ‘realiteit’: heldere kleuren, dramatische composities en vol filmisch gevoel. Dit ‘gefabriceerde drama’ maakte het voor mensen gemakkelijker om hun waakzaamheid te laten verslappen.

Hany Farid, een professor aan de University of California, Berkeley, en algemeen beschouwd als een van de grondleggers van het gebied van digitaal forensisch onderzoek, heeft een andere "verborgen zwakte" van AI-beelden uitgebuit. Zijn aanpak is niet om te zoeken naar duidelijke visuele fouten, maar om de gegenereerde beelden te vergelijken met de geometrische relaties die in de echte wereld zouden moeten verschijnen. Volgens hem hebben de bestaande modellen voor het genereren van beelden het basisconcept van de kunstles – het verdwijnpunt – nog niet echt geleerd.

Neem als voorbeeld een door AI gegenereerde foto van 'soldaten die door de gang marcheren'. Je kunt enkele voor de hand liggende gebreken in de afbeelding zien, zoals wazige en moeilijk leesbare tekst op de muur, onverklaarbare kettingen, enz. Maar de meer kritische aanwijzing zit verborgen in de tegels op de grond: volgens het principe van perspectief moeten parallelle lijnen in werkelijkheid (zoals de naden van vloertegels en houten vloeren) zich uitstrekken en samenkomen naar hetzelfde verdwijnpunt in de afbeelding. Als u met het Lijngereedschap lijnen langs deze structuren tekent, kunt u controleren of ze elkaar in de verte ontmoeten, zoals op een echte foto, waardoor u een eerste idee krijgt of de afbeelding betrouwbaar is.

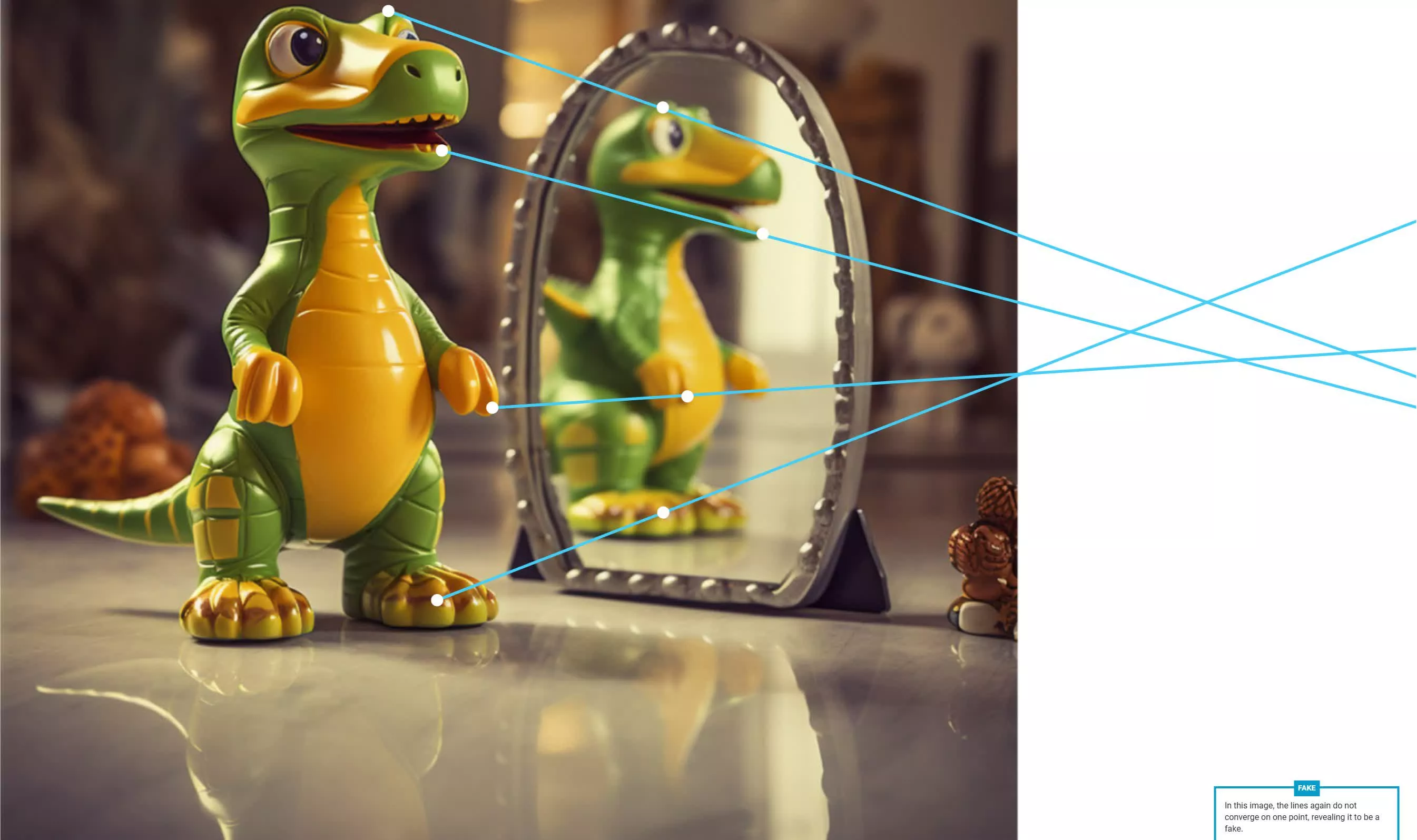

Vergelijkbare geometrische relaties zijn ook van toepassing op reflecties. Onderzoek wijst uit dat hoewel de huidige generatieve modellen al water- of spiegelreflecties kunnen synthetiseren die voldoende zijn om het menselijk oog voor de gek te houden, problemen aan het licht zullen komen zolang je een liniaal gebruikt om ze te meten. In de echte wereld moeten de lijnen die een bepaald punt van een object en het corresponderende reflectiepunt verbinden parallel aan elkaar zijn en naar hetzelfde verdwijnpunt wijzen nadat ze zijn verlengd; zodra deze lijnen buitensporige afwijkingen lijken te vertonen, betekent dit waarschijnlijk dat dit een samengesteld beeld is.

De schaduwen van de zon zorgen ook voor extra grip bij dit soort tests. Omdat de zon extreem ver van de aarde verwijderd is, kan er bij benadering worden aangenomen dat het zonlicht dat de grond raakt, parallel licht is. Volgens dit uitgangspunt zou de lijn tussen een bepaald punt van het object en het overeenkomstige punt in de schaduw ook moeten kunnen worden verlengd en convergeren naar een verdwijnpunt. Als de schaduwlijnen van verschillende objecten op een foto niet naar een consistente geometrische relatie kunnen verwijzen, is de kans groot dat dit in strijd is met de basiswetten van de optica.

Het is momenteel moeilijk te voorspellen wanneer en of generatieve modellen deze fouten op fysiek niveau fundamenteel kunnen overwinnen. Vergeleken met de gebreken die in de beginperiode gemakkelijk met het blote oog waarneembaar waren, vereist 'geometrische verificatie' op basis van perspectief en licht dat waarnemers meer tijd en energie moeten besteden, wat de dagelijkse waakzaamheidsdrempel van de gemiddelde gebruiker van sociale media ver overschrijdt. Sommige onderzoekers zijn zelfs van mening dat een diep begrip van dergelijke fysieke regels de ontwerpmogelijkheden van de huidige reguliere generatieve modellen te boven gaat.

Naast dit werk herinneren experts gebruikers er ook aan voorzichtig te zijn met het "gebruiken van AI om AI te identificeren". Sommige automatische detectiehulpmiddelen kunnen onder bepaalde omstandigheden inderdaad betrouwbaarder zijn dan het ongetrainde menselijke oog, maar zodra de distributie van het invoerbeeld en de trainingsgegevens ervan te verschillend zijn, zal het algoritme te maken krijgen met fouten en zelfs systematische vooroordelen. Met andere woorden: het volledig overdragen van de screeningstaak aan een ander black box-model is geen waterdichte oplossing.

Een gerelateerd onderzoek deed ook een intrigerende ontdekking: bevestigen dat een foto ‘echt’ is, kan moeilijker zijn dan het identificeren van een ‘nepfoto’. Uit het onderzoek bleek dat hoe langer een kijker naar een afbeelding keek zonder een fout te ontdekken, hoe groter de kans was dat het een echte foto was. Vanuit dit perspectief kan ‘geen fout gevonden’ zelf een van de bewijzen van authenticiteit worden.