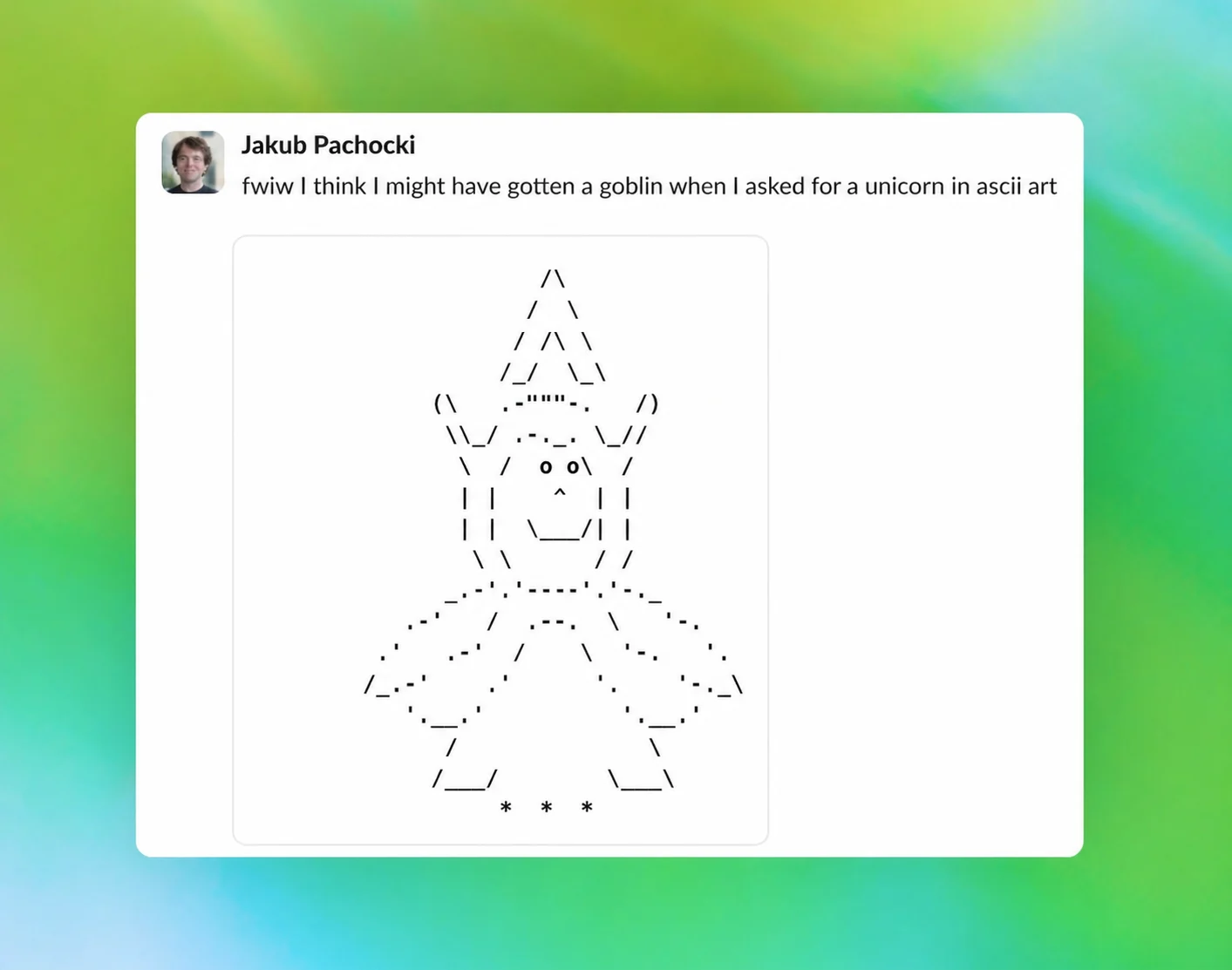

Nadat "Wired" onthulde dat OpenAI zijn programmeermodel een interne instructie had gegeven om "nooit over goblins, gremlins, wasberen, trollen, ogres, duiven of andere dieren of wezens te praten", heeft OpenAI een artikel op zijn officiële website gepubliceerd om dit fenomeen uit te leggen, waarbij wordt gezegd dat dit een "vreemde gewoonte" is die het model tijdens het trainingsproces heeft gevormd.

OpenAI verklaarde dat dit soort metaforische uitdrukkingen waarbij goblins en andere wezens betrokken zijn, voor het eerst duidelijk werd opgemerkt in het GPT-5.1-model, vooral wanneer de persoonlijkheidsoptie "Nerdy" is ingeschakeld. Volgens het bedrijf is deze manier van uitdrukken niet verdwenen, maar heeft zich geleidelijk verspreid naarmate de volgende modellen zich blijven herhalen.

OpenAI wees er in de beschrijving op dat de wortel van het probleem verband houdt met het trainen van versterkend leren: hoewel de relevante beloningen aanvankelijk alleen worden opgelegd onder de 'Nerdy'-persoonlijkheidsconditie, garandeert versterkend leren niet dat het aangeleerde gedrag altijd strikt beperkt blijft tot de omstandigheden die het hebben veroorzaakt. Zodra een bepaalde taalstijl of expressie-eigenaardigheid wordt beloond, kunnen daaropvolgende trainingsprocessen deze naar andere scenario's propageren, vooral wanneer deze resultaten worden hergebruikt voor gecontroleerde verfijning of training van voorkeursgegevens. Deze tendens zal nog verder worden versterkt.

Volgens rapporten zijn dergelijke uitingen over goblins en gremlins inderdaad afgenomen, maar zijn ze niet volledig verdwenen, sinds OpenAI in maart van dit jaar stopte met het aanbieden van de 'Nerdy'-persoonlijkheid. Vooral in het GPT-5.5-model dat door de Codex-programmeertool wordt gebruikt, blijven relevante uitdrukkingen erin zitten, omdat OpenAI het model begon te trainen voordat de "oorzaak" werd geïdentificeerd.

Hierdoor moest OpenAI uiteindelijk zeer specifieke beperkingen aan de Codex toevoegen, waarbij expliciet werd geëist dat deze mythische wezens niet opnieuw werden genoemd. Het rapport vermeldde echter ook dat als iemand wil dat zijn AI een beetje van deze "Goblin-stijl" behoudt bij het schrijven van code, OpenAI zelfs publiekelijk een methode heeft gedeeld die kan worden gebruikt om de relevante beperkingen in te trekken.

Afgaande op deze reactie weerspiegelt dit, achter dit ogenschijnlijk absurde ‘Goblin-probleem’, feitelijk een realistischer probleem bij het trainen van grote modellen: sommige taalgewoonten die alleen in specifieke persoonlijkheidssituaties zouden moeten voorkomen, kunnen overslaan naar een breder scala aan modelgedragingen onder het gesuperponeerde effect van het beloningsmechanisme en de daaropvolgende training. Voor OpenAI is dit niet alleen een publieke verklaring van de uit de hand gelopen modelstijl, maar ook een inkijkje in de complexiteit waarmee het wordt geconfronteerd bij het corrigeren van subtiele gedragsafwijkingen in generatieve AI.