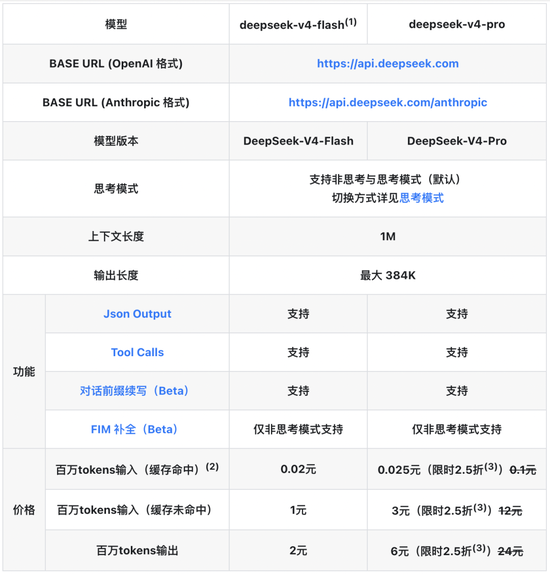

DeepSeek herdefinieert de grenzen van de inclusie van grote modellen. Op 26 april bracht DeepSeek officieel een aankondiging van een API-prijsaanpassing uit. De prijs van alle API-invoercachehits is verlaagd tot een tiende van de initiële prijs. De V4-Pro-upgrade krijgt voor een beperkte tijd 25% korting, en de invoercache-hits van een miljoen tokens zijn zo laag als 0,025 yuan, wat een nieuw dieptepunt vormt in de prijs van grote modellen ter wereld.

Volgens de aankondiging op de officiële API-prijspagina van DeepSeek geldt deze prijsverlaging voor alle modellen van de V4-serie, en zijn de kernaanpassingen gericht op scenario's met invoercache-hits. Onder hen daalde de prijs van de DeepSeek-V4-Flash-invoercache van 0,2 yuan/miljoen tokens naar 0,02 yuan/miljoen tokens.

DeepSeek-V4-Pro voor gebruikers op ondernemingsniveau biedt zelfs nog grotere kortingen. De oorspronkelijke prijs van 1 yuan/miljoen tokens wordt verlaagd naar 0,1 yuan voor cache-invoer. Vóór 5 mei 2026 wordt een tijdelijke speciale aanbieding van 25% toegevoegd, wat eigenlijk slechts 0,025 yuan/miljoen tokens bedraagt. De cache-misserinvoer wordt teruggebracht van 12 yuan naar 3 yuan, en de output wordt teruggebracht van 24 yuan naar 6 yuan.

Afbeeldingsbron: officiële website van DeepSeek

DeepSeek vermeldde dat de twee modelnamen DeepSeek-Chat en DeepSeek-Reasoner in de toekomst zullen worden verouderd. Om compatibiliteitsredenen komen de twee overeen met respectievelijk de niet-denkende en denkende modi van DeepSeek-V4-Flash.

Als je de prijzen voor en na de prijsaanpassing vergelijkt, kun je gemakkelijk vaststellen dat de kosten van hoogfrequente gesprekken en lange tekstverwerkingsscenario's met meer dan 90% zijn gedaald. Applicaties met hoge cachehitrates, zoals de RAG-kennisbank, intelligente klantenservice en documentanalyse, kunnen direct een enorme daling van de commerciële kosten realiseren, waardoor de kostenbarrières van grootschalige implementatie van AI worden doorbroken.

De aanzienlijke prijsverlaging van DeepSeek houdt verband met de technologische upgrade van DeepSeek-V4 en de diepgaande samenwerking met het Shengteng-ecosysteem.

Op 24 april werd de previewversie van DeepSeek‑V4 officieel uitgebracht. Zowel open source Pro- als Flash-modellen ondersteunen ultralange contexten van 1 miljoen tokens. De zelfontwikkelde spaarzame aandachtsarchitectuur vermindert het verbruik van inferentierekenkracht aanzienlijk. De single-token rekenkracht van de Pro-versie bedraagt slechts 27% van die van V3.2, en de KV-cache is teruggebracht tot 10%, waardoor kostenoptimalisatie van onderaf wordt bereikt.

Uit de door DeepSeek aangekondigde parameters blijkt dat DeepSeek-V4-Pro 49B-activeringsparameters en 33T pre-trainingsgegevens heeft, waardoor het een krachtig vlaggenschip is; DeepSeek‑V4‑Flash heeft 13 miljard activeringsparameters en 32T pre-trainingsgegevens, gericht op hoge snelheid en lage kosten.

Vergeleken met het model van de vorige generatie zijn de Agent-mogelijkheden van DeepSeek-V4-Pro aanzienlijk verbeterd. In de Agentic Coding-evaluatie heeft V4-Pro het beste niveau van de huidige open source-modellen bereikt, en presteerde het ook goed in andere Agent-gerelateerde evaluaties. Er wordt gemeld dat DeepSeek-V4 het Agentic Coding-model is geworden dat door interne medewerkers van DeepSeek wordt gebruikt. Volgens evaluatiefeedback is de gebruikservaring beter dan die van Sonnet 4.5 en ligt de leveringskwaliteit dicht bij de niet-denkmodus van Claude Opus 4.6, maar er is nog steeds een zekere kloof met de denkmodus van Opus 4.6.

In de wereldkennisevaluatie loopt DeepSeek-V4-Pro aanzienlijk voor op andere open source-modellen en enigszins inferieur aan het beste closed source-model Gemini-Pro-3.1. Bij de evaluatie van wiskunde, STEM en competitieve codes overtrof DeepSeek-V4-Pro alle momenteel publiekelijk geëvalueerde open source-modellen en was vergelijkbaar met 's werelds beste closed source-modellen.

Vergeleken met DeepSeek-V4-Pro is DeepSeek-V4-Flash iets inferieur in termen van mondiale kennisreserve, maar het vertoont een goed redeneervermogen. Omdat de modelparameters en activeringen kleiner zijn, kan V4-Flash snellere en zuinigere API-diensten leveren.

DeepSeek-V4 was ook een pionier op het gebied van een nieuw aandachtsmechanisme dat de tokendimensie comprimeert en combineert met DSA-sparse aandacht (DeepSeek Sparse Attention) om toonaangevende lange-contextmogelijkheden te bereiken en de computer- en grafische geheugenvereisten aanzienlijk te verminderen in vergelijking met traditionele methoden.

Wat nog opmerkelijker is, is dat het hele assortiment Ascend-supernode-producten de modellen uit de DeepSeek V4-serie ondersteunt. Dit betekent ook dat DeepSeek meer lokalisatiesignalen vrijgeeft.

DeepSeek-V4 vermeldt in een technisch rapport: "Het fijnmazige EP-schema (Expert Parallel) werd geverifieerd op twee platforms, NVIDIA GPU en Huawei Ascend NPU. Vergeleken met de krachtige niet-gefuseerde basislijn bereikte het schema een versnelling van 1,50-1,73 keer bij algemene redeneertaken; in latentiegevoelige scenario's (zoals de uitrol van versterkend leren (RL) en snelle Agent-services) kan het een versnelling tot 1,96 keer bereiken."

DeepSeek benadrukte dat naarmate het volledige assortiment Ascend-supernode-producten in de tweede helft van het jaar in batches wordt gelanceerd, de prijs van de Pro-versie naar verwachting aanzienlijk zal worden verlaagd.

Na de release van DeepSeek-V4 bracht Goldman Sachs een analyserapport uit waarin hij erop wees dat de kernbetekenis van DeepSeek V4 het ondersteunen van de implementatie van complexere agentapplicaties tegen lagere kosten is, waardoor een nieuwe ruimte wordt geopend voor de schaal van AI-applicaties. Met betrekking tot de opname van Ascend-superknooppunten is Goldman Sachs van mening dat het kostenconcurrentievermogen van DeepSeek verder zal worden versterkt, waardoor de voorwaarden worden geschapen voor een breder scala aan toepassingen. Bovendien wordt, tegen de achtergrond van de voortdurende verkrapping van chips, de trend van het migreren van China's beste AI-modellen naar binnenlandse rekenkracht duidelijk onderschreven door leidende spelers.

Het Goldman Sachs-rapport citeerde ook nieuwsberichten dat Tencent en Alibaba onderhandelen om in DeepSeek te investeren tegen een waardering van meer dan 20 miljard dollar. De laatste marktwaarden van Zhipu en MiniMax bedragen respectievelijk ongeveer 53 miljard dollar en 31 miljard dollar. Deze potentiële transactie weerspiegelt de logica van de concurrentie van de reuzen om de schaarse AI-capaciteiten op het hoogste niveau.

Huatai Securities is van mening dat de markt V4 gemakkelijk interpreteert als "kostenreductie en verminderde rekenkracht en opslagvereisten", maar de belangrijkste marginale verandering is dat nadat de kosten van een lange context afnemen, de beschikbaarheid van complexe agenten, analyse van meerdere documenten, langetermijntaken, online leren en andere scenario's zal toenemen, en dat het aantal inferentieoproepen en de frequentie van toegang tot opslag naar verwachting zal toenemen.