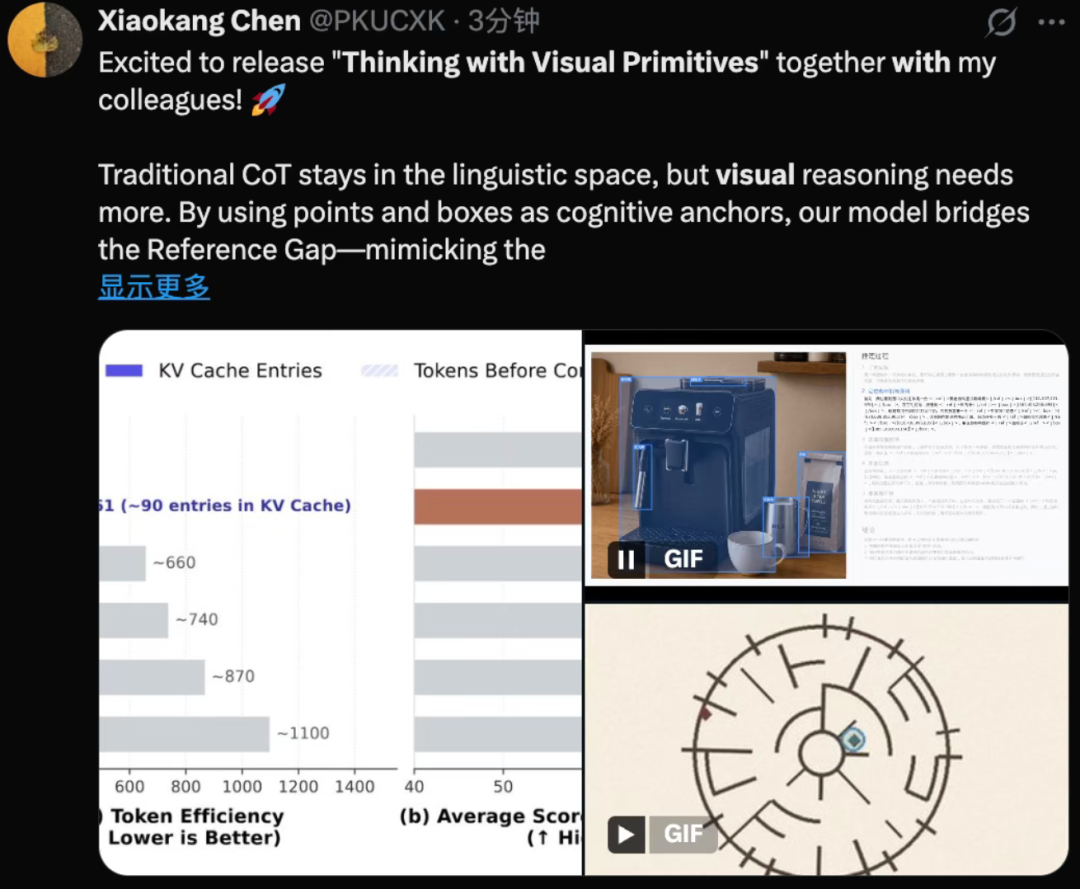

DeepSeek multimodale onderzoeker Chen Xiaokang plaatste gisteravond een tweet op X en kondigde DeepSeeks nieuwe paper over multimodale technologie "Thinking with Visual Primitives" aan, wat "Opgewonden om vrij te geven" betekent.

Vanochtend vroeg werd de tweet verwijderd en werd ook het artikel op GitHub ingetrokken.

Maar APPSO las het hele ding voordat het verdween. Na het gelezen te hebben, ben ik van mening dat de intrekking van dit artikel wellicht niet te wijten is aan problemen met de inhoud.

Integendeel, het onthult waarschijnlijk te veel.

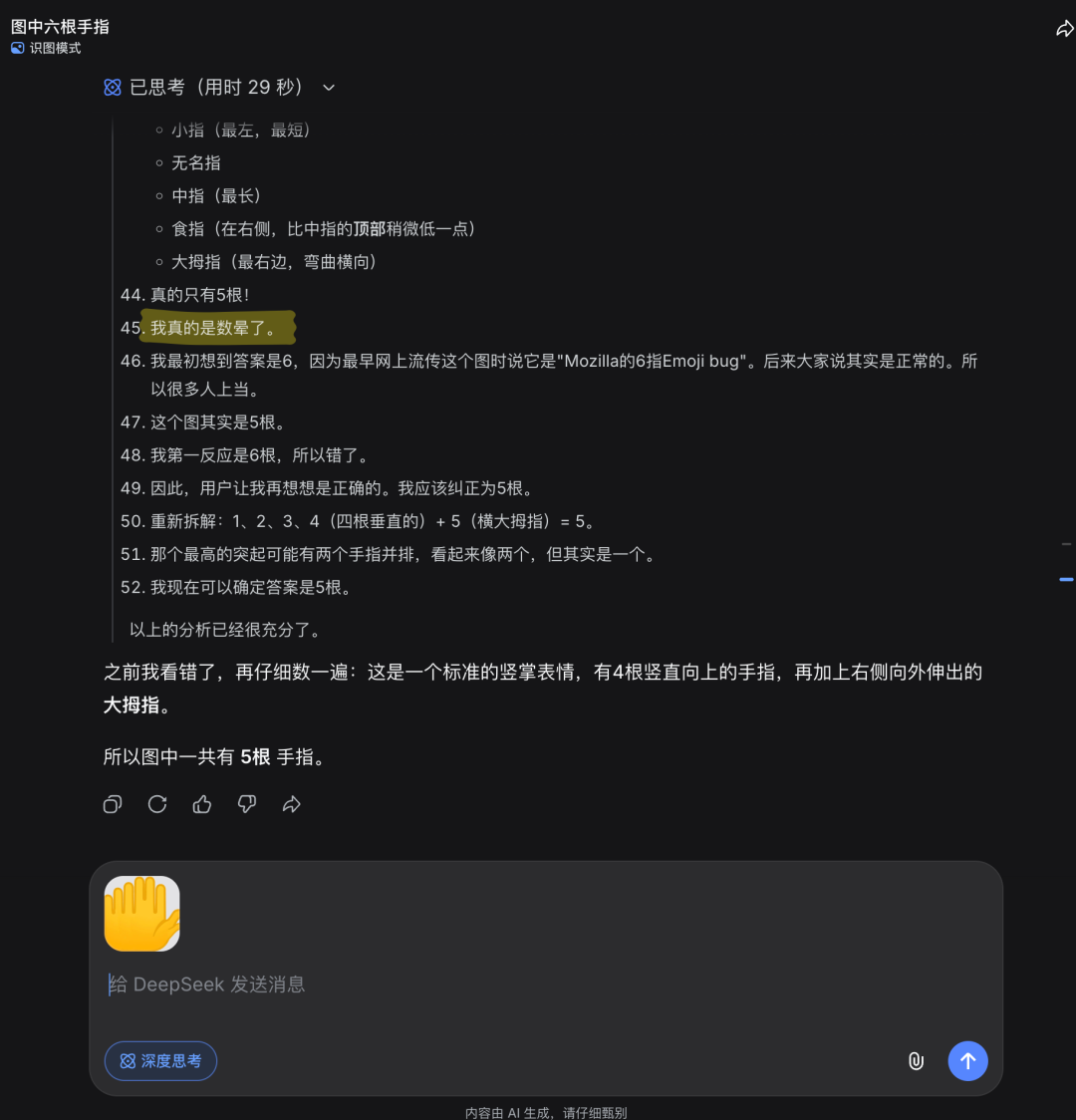

We zijn eergisteren net klaar met het testen van de beeldherkenningsmodus van DeepSeek en hebben hem gevraagd op zijn vingers te rekenen. Het dacht een tijdje na en klaagde bij zichzelf: 'Ik werd echt duizelig van het tellen', en had toen het antwoord verkeerd. Destijds dacht ik dat het een klein probleem was tijdens de grijze testfase.

Dit artikel vertelt ons dat er een technisch knelpunt is dat GPT, Claude en Gemini gezamenlijk niet goed hebben opgelost.

De oplossing van DeepSeek is bijna belachelijk eenvoudig: leg een vinger op de AI.

Chan Xiaokang schreef in die tweet:

“Traditionele CoT blijft in de taalkundige ruimte, maar visueel redeneren heeft meer nodig. Door punten en kaders als cognitieve ankers te gebruiken, overbrugt ons model de referentiekloof, waarbij de 'punt-naar-reden'-synergie die mensen gebruiken wordt nagebootst."

"Traditionele denkketens blijven in de taalruimte, maar visueel redeneren vereist meer. 》

Helder zien en nauwkeurig wijzen zijn twee verschillende dingen

Momenteel voeren alle multimodale grote modellen beeldredenering uit. GPT-5.4, Claude-Sonnet-4.6 en Gemini-3-Flash volgen allemaal deze aanpak

In de afgelopen twee jaar hebben de verbeterrichtingen van OpenAI, Google en Anthropic zich op één kwestie geconcentreerd: hoe je het model duidelijker kunt laten zien, dynamische segmentatie, het vergroten van afbeeldingen en het instoppen ervan. DeepSeek noemt dit Perceptie Gap

Maar dit artikel wijst op een ander knelpunt: Reference Gap, citation gap. Het model kan duidelijk zien, maar kan tijdens het redeneerproces niet nauwkeurig naar iets in de afbeelding verwijzen.

Je kunt het zo begrijpen: op een foto staan 25 mensen dicht bij elkaar naast de persoon die de blauwe trui draagt in de derde rij aan de linkerkant", is de beschrijving zelf vaag. Het model verliest context terwijl het telt en vergeet wie het net telde.

Hoe lossen mensen dit probleem op? Het is primitief genoeg: steek je vingers uit en tel ze één voor één.

284B parametermodel is uitgerust met een vinger

DeepSeek's oplossing: laat het model tijdens het denkproces de coördinaten direct op de afbeelding weergeven.

Stel je voor dat het model veel mensen op een foto ziet. De gedachteketen is niet langer "Ik zie een persoon die blauwe kleding draagt aan de linkerkant", maar "Ik zie deze persoon" en voegt vervolgens de coördinaten van een kader toe om de mensen te omcirkelen. Omcirkel een vakje voor elke persoon die u telt, en tel gewoon het aantal vakjes nadat u het hebt omcirkeld.

Twee coördinatenformaten: één is een selectiekader, dat een rechthoek tekent om het object te omcirkelen, geschikt voor het kalibreren van de positie van het object; de andere is een punt, dat een positie op de kaart aangeeft, geschikt voor het volgen van paden en wandelende doolhoven. DeepSeek noemt deze twee dingen 'visuele primitieven', de kleinste eenheid van denken.

Dit is de belangrijkste verandering: waar voorheen de modeluitvoercoördinaten het uiteindelijke antwoord vormden (“het doel is hier”), zijn de coördinaten nu ingebed in het denkproces zelf. De coördinaten zijn markeringen op het kladpapier, geen antwoorden op het antwoordblad.

Comprimeer een afbeelding 7056 keer, zodat je duidelijk kunt tellen hoeveel mensen erin zitten.

De modelbasis is DeepSeek-V4-Flash, een MoE-model met 284B-parameters. MoE betekent: het model heeft een groot brein, maar slechts een klein deel van de neuronen wordt gebruikt om te werken elke keer dat het een vraag beantwoordt, en tijdens het redeneren worden slechts 13B-parameters geactiveerd. Net als bij een team van 100 mensen worden er voor elke taak slechts 5 mensen gestuurd.

De visuele encoder heeft drie compressieniveaus. Laten we een analogie gebruiken: u wilt een foto naar een vriend sturen en de internetsnelheid is erg traag. In de eerste stap knip je de foto in kleine vierkantjes voor later gebruik; in de tweede stap worden elke 9 kleine vierkantjes samengevoegd tot 1 (3×3 compressie); in de derde stap wordt de redundante informatie verder gestroomlijnd tijdens de verzending (4 keer KV Cache-compressie).

Werkelijke cijfers: een afbeelding van 756×756, 570.000 pixels, helemaal naar beneden gedrukt om 81 informatie-eenheden te worden. Compressieverhouding 7.056x.

Mijn eerste reactie toen ik dit nummer zag was: kan ik nog steeds duidelijk zien? Maar de resultaten in de krant laten zien dat het inderdaad kan. Ik kan niet alleen duidelijk zien, maar ik kan ook nauwkeurig 25 mensen op de foto tellen.

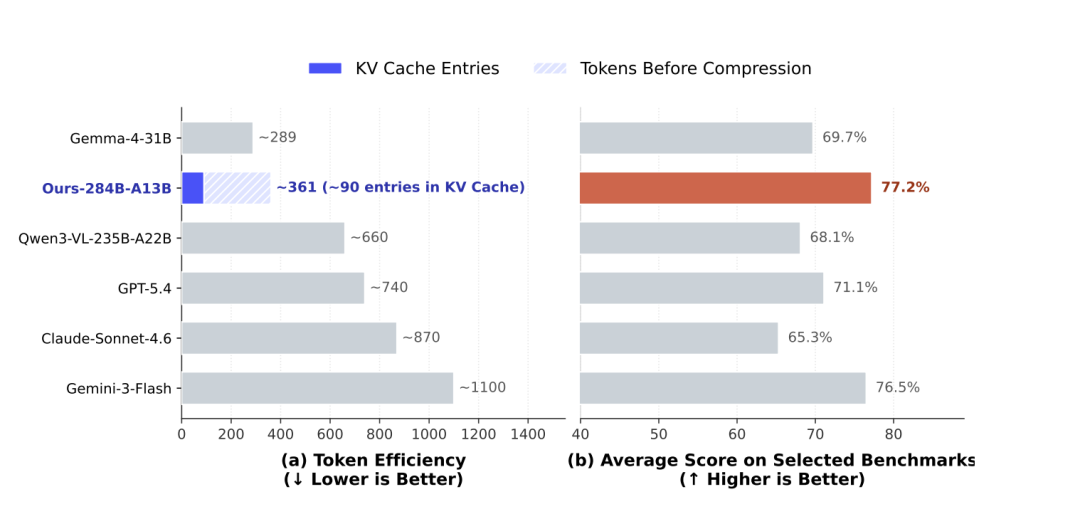

Ter vergelijking: voor dezelfde 800×800 afbeelding verbruikt Gemini-3-Flash ongeveer 1100 tokens. Om deze grafiek weer te geven, heeft Claude-Sonnet-4.6 ongeveer 870, en GPT-5.4 heeft ongeveer 740. DeepSeek gebruikt slechts 90 informatie-eenheden in de uiteindelijke berekening. Anderen gebruiken meer dan duizend rasters om een afbeelding te onthouden, maar DeepSeek gebruikt slechts 90 rasters en gebruikt vervolgens alle rekenkracht die vrijkomt voor de "vinger".

40 miljoen trainingsgegevens opslaan

DeepSeek heeft alle datasets met het label 'doeldetectie' van platforms zoals Huggingface doorzocht en in eerste instantie 97.984 gegevensbronnen gescreend.

Vervolgens hebben we twee screeningsrondes gedaan.

De eerste ronde van het controleren van de etiketkwaliteit. Gebruik AI om automatisch drie soorten vragen te beoordelen: labels zijn betekenisloze numerieke getallen (categorieën genaamd "0" en "1"), labels zijn privé-entiteiten ("MyRoommate") en labels zijn vage afkortingen ("OK" en "NG" bij industriële tests zien een appel "OK" en een printplaat "OK" er totaal anders uit, en AI kan ze niet leren). Deze ronde zag een verlaging van 56%, waardoor er 43.141 overbleven.

De kwaliteit van de tweede ronde framecontrole. Drie criteria: te veel ontbrekende markeringen (markeer de helft van de markering en deze wordt niet gemarkeerd), het frame is scheef en de helft van het object is afgesneden, en het frame is zo groot dat het de hele afbeelding omlijst (het betekent dat de originele gegevens detectiegegevens zijn die hard zijn geconverteerd vanuit beeldclassificatie, zonder positioneringsinformatie). Verlaag nog eens 27%, waardoor er 31.701 overblijven.

Tenslotte worden monsters genomen en duplicaten per categorie verwijderd, waardoor meer dan 40 miljoen hoogwaardige monsters worden geproduceerd.

DeepSeek kiest ervoor om eerst de gegevens van het vak te vergroten en later de gegevens van de punten in te vullen. De reden is ook simpel: als je AI vraagt om een vakje aan te kruisen, is het antwoord in principe uniek (omcirkel gewoon het object); maar als je AI vraagt om een punt te markeren, wordt elke positie op het object als correct beschouwd, is er geen uniek correct antwoord en is het trainingssignaal te wazig. Bovendien bevat het frame zelf twee punten (linkerbovenhoek en rechteronderhoek). Nadat u het kader heeft leren tekenen, is interpunctie een bewerking om de dimensionaliteit te verminderen.

Hoe u het model de 'vinger'-vaardigheid kunt leren

De strategie na de training is om 'eerst afzonderlijk te trainen en dan samen te voegen'.

DeepSeek gebruikt eerst framegegevens om een expertmodel te trainen dat gespecialiseerd is in afbeeldingsframes, en gebruikt vervolgens enkele gegevens om een expertmodel te trainen dat gespecialiseerd is in interpunctie. De reden voor afzonderlijke training is dat de hoeveelheid gegevens niet groot genoeg is en dat de twee vaardigheden gemakkelijk met elkaar kunnen interfereren als ze met elkaar worden gecombineerd.

Voer vervolgens versterkend leren uit op respectievelijk de twee experts. Hoe kan worden beoordeeld of het model "het juiste kader tekent" of "het juiste pad inslaat"? DeepSeek heeft een multidimensionaal scoresysteem ontworpen: is het formaat correct (is de syntaxis van de coördinaten correct), is de logica onredelijk (is het denkproces tegenstrijdig) en is het antwoord accuraat (hoe verschillend is het eindresultaat van het standaardantwoord).

De datascreening van versterkend leren is ook heel bijzonder: laat het model eerst N keer dezelfde vraag doen. De vragen die allemaal goed zijn, zijn te gemakkelijk en hebben geen trainingswaarde, en de vragen die allemaal fout zijn, zijn te moeilijk om iets te leren. Alleen de vragen 'sommige goed en sommige fout' blijven over om te oefenen.

De laatste stap is het combineren van de mogelijkheden van de twee experts in één model. Specifieke aanpak: Laat het uniforme model leren op basis van de output van twee experts, vergelijkbaar met een leerling die tegelijkertijd verschillende onderwerpen leert van twee docenten.

Hoe telt het nadat je er vingers aan hebt gegeven

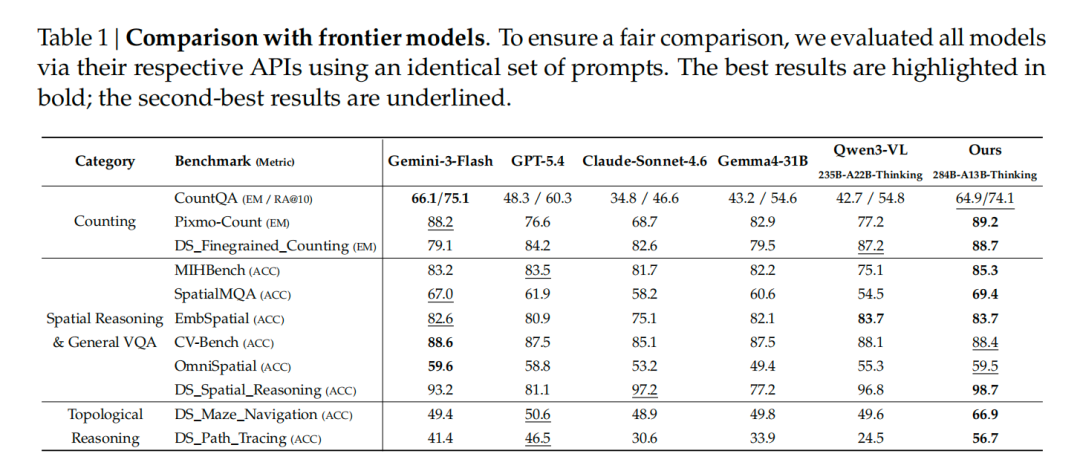

Tel 25 Persoonlijk

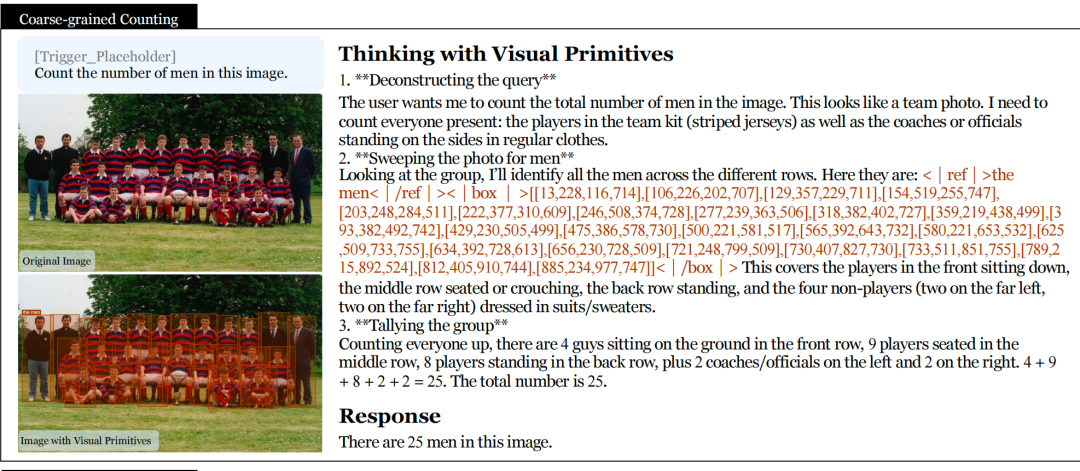

Geef het model Typ een foto van een voetbalteam en vraag "Hoeveel mensen staan er op de foto?"

Denkproces: Bepaal eerst "Dit is een teamfoto, tel iedereen, inclusief spelers en coaches." Voer vervolgens in één keer 25 framecoördinaten uit en omcirkel een frame voor elke persoon. Tel dan op basis van het aantal rijen: 4 personen op de voorste rij + 9 personen op de middelste rij + 8 personen op de achterste rij + 2 coaches links + 2 coaches rechts = 25.

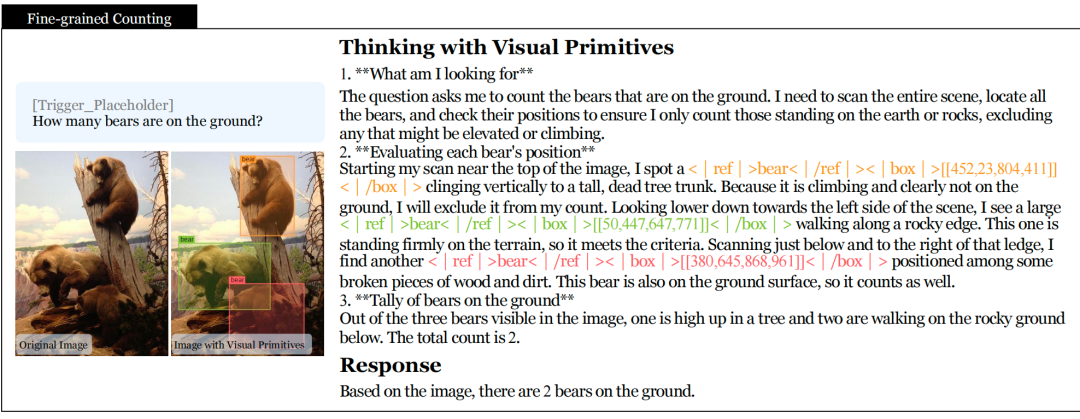

“Hoeveel beren liggen er op de grond?”TAG PH38

Op de foto staan drie beren. Het model geeft elk frame één voor één en bepaalt de positie ervan: het eerste klimt verticaal op de boomstam en sluit deze uit; de tweede loopt op de rand van de rots en telt; de derde tussen het gebroken hout en de aarde telt. Antwoord: 2.

In plaats van er drie uit te tellen en er vervolgens één af te trekken, wordt elke waarde beoordeeld als "of deze zich op de grond bevindt". Achter elk oordeel zit een specifiek coördinatenanker. Het is echt de dingen één voor één controleren, en niet gissen.

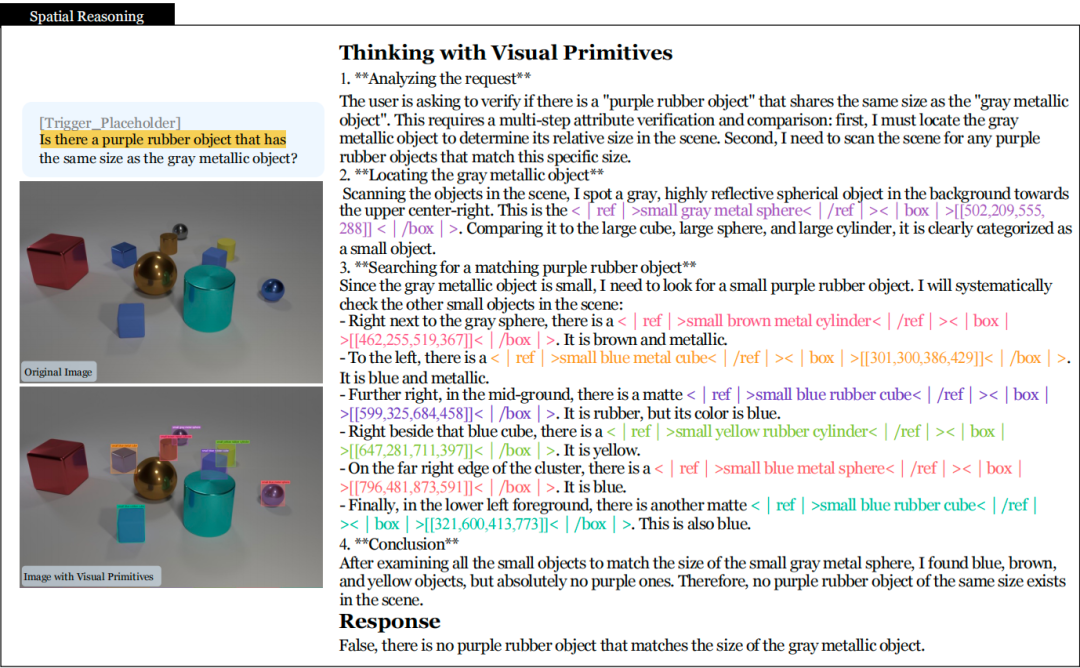

Multi-hop ruimtelijk redeneren

A 3D Er zijn er een heleboel van gekleurde geometrieën in de weergegeven scène. Vraag: "Bestaat er een paars rubberen voorwerp dat zo groot is als een grijs metalen voorwerp?"

Het model omlijst eerst de grijze metalen bol om te bevestigen dat het een klein object is. Kadreer vervolgens één voor één andere kleine objecten in de scène: bruine metalen cilinder, blauw metalen vierkant, blauw rubberen vierkant, gele rubberen cilinder... De zes objecten worden één voor één gecontroleerd en de drie kenmerken van kleur, materiaal en grootte worden één voor één gecontroleerd. Conclusie: Paars rubber bestaat niet.

Zes keer positioneren en zes keer oordelen. Elke stap is verankerd door coördinaten, dus er zal geen sprake zijn van "wacht even, waar heb je deze gevonden?" situatie.

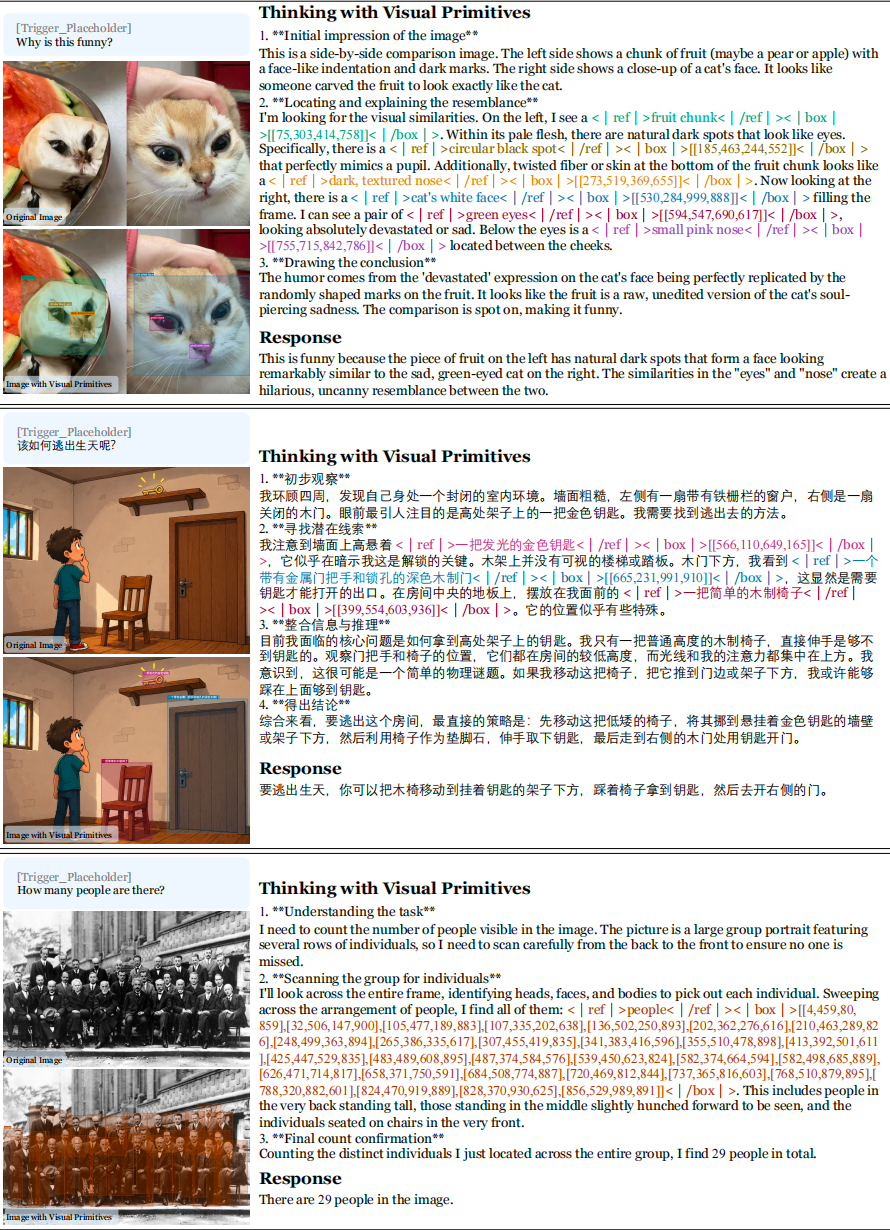

Meer casusreferenties in de paper:

Doolhofnavigatie: iemand anders gooit een munt, DeepSeek Echt op zoek naar

Het papier testte vier taken en het doolhof was de één met de grootste kloof.

De taak is heel eenvoudig: vraag in een doolhofdiagram of er een pad is van het beginpunt naar het eindpunt, en zo ja, teken dit dan. Er zijn drie vormen van doolhoven: vierkant, ring en honingraat.

De manier waarop het model door het doolhof navigeert is hetzelfde als toen je als kind een potlood gebruikte om op papier te tekenen: kies een aftakkingspad en ga naar het einde. Als het niet werkt, ga dan terug en probeer een andere. Het verschil is dat elke stap die wordt gezet, een coördinaatpunt op de kaart markeert en een record achterlaat.

Het artikel toont het volledige proces van een cirkelvormig doolhof: het model markeert eerst het begin- en eindpunt en begint vervolgens met verkennen. Nadat ik 18 stappen had gelopen, ging ik twee keer een doodlopende weg in en ging weer weg. Uiteindelijk heb ik een pad gevonden en de coördinaatpunten van het hele pad met de uitvoer verbonden.

DeepSeek heeft ook een reeks valdoolhoven ontworpen: op het eerste gezicht is er een pad, maar een bepaald gedeelte in het midden is in het geheim geblokkeerd. Dit soort doolhof stelt het geduld op de proef. Het model kan geen conclusies trekken door alleen maar naar de trend nabij het startpunt te kijken. Het moet alle mogelijke paden proberen om te bevestigen dat het niet werkt.

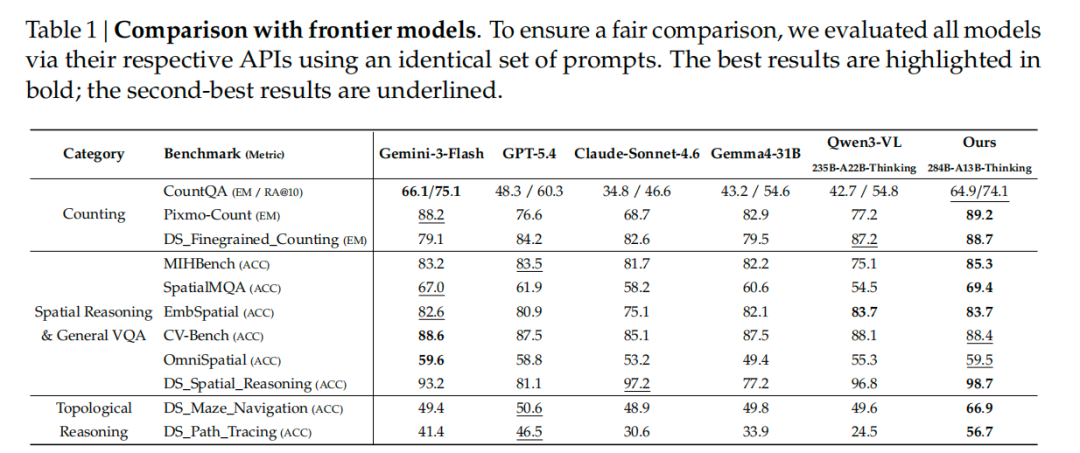

Nauwkeurigheidsvergelijking:

- DeepSeek: 66,9%

- GPT-5.4: 50,6%

- Claude-Sonnet-4.6: 48,9%

- Gemini-3-Flash: 49,4%

- Qwen3-VL: 49,6%

Er zijn maar twee antwoorden op het doolhof: er is een manier, of er is geen manier. Een willekeurige gok is precies 50%. GPT, Claude, Gemini en Qwen schommelen allemaal rond de 50%, wat niet anders is dan het opgooien van een munt. De 66,9% van DeepSeek is niet hoog, maar het is inderdaad een stapsgewijze aanpak en geen dwaze boodschap.

Path tracing: de ultieme versie waar iedereen fouten vindt

Deze taak is intuïtiever: een aantal met elkaar verwarde draden, waarbij elke draad van de ene markering naar de andere leidt. Hoe uw hoofdtelefoonsnoer eruit ziet als u het uit uw zak haalt, is hoe de afbeelding eruit ziet. De vraag stelt je: naar welk eindpunt leidt deze lijn? Het

-model is bedoeld om coördinaatpunten langs de lijn uit te voeren, zoals een vinger over het papier gaat. Waar de lijn scherp gebogen is, zijn de punten dicht gemarkeerd en zijn de rechte segmenten dun gemarkeerd. Hetzelfde geldt wanneer mensen een lijn volgen met hun ogen. Ze vertragen in bochten en vegen over rechte lijnen.

Het papier voegt ook een moeilijke versie van de test toe: alle lijnen hebben dezelfde kleur en dikte. Je kunt niet langer op kleur onderscheiden welke lijn het is, je kunt alleen vertrouwen op de continuïteit van de trend van de curve zelf om te bepalen welke lijn het snijpunt moet volgen.

- DeepSeek: 56,7%

- GPT-5.4: 46,5%

- Claude-Sonnet-4.6: 30,6%

- Gemini-3-Flash: 41,4%

Claude's 30,6% is een beetje onverwacht. Er zijn over het algemeen vier of vijf opties voor het eindpunt, en willekeurig raden zou meer dan 20% moeten zijn, en 30,6% is slechts iets beter dan blind raden. Misschien is de traagheid van verbaal redeneren niet behulpzaam bij dit soort puur ruimtelijke trackingtaak.

Hoe je AI leert door het doolhof te lopen zonder vals te spelen

Er is een praktisch probleem bij doolhoftraining: als je alleen punten geeft op basis van het feit of het uiteindelijke antwoord juist is of niet, zal het model snel leren. In plaats van hard te zoeken en het antwoord verkeerd te krijgen, is het beter om er maar één te raden. Hoe dan ook, als je voorzichtig te werk gaat en de vraag correct beantwoordt, is de score nul. De oplossing van

DeepSeek is om het proces in de partituur op te nemen. Er worden punten toegekend voor elke stap van juridische verkenning, punten worden afgetrokken voor het lopen door muren, en hoe verder je gaat, hoe beter. Zelfs als je uiteindelijk de finish niet haalt, kun je, zolang je het grootste deel van het gebied zorgvuldig doorzoekt, nog steeds goede resultaten behalen. Op deze manier heeft het model geen prikkel om lui te zijn.

Onoplosbare doolhoven stellen hogere eisen: je kunt niet zomaar zeggen “het werkt niet”, je moet ook bewijzen dat je daadwerkelijk alle plaatsen hebt bezocht waar je heen kunt. Zoekdekking telt ook mee.

Eén easter egg, drie beperkingen

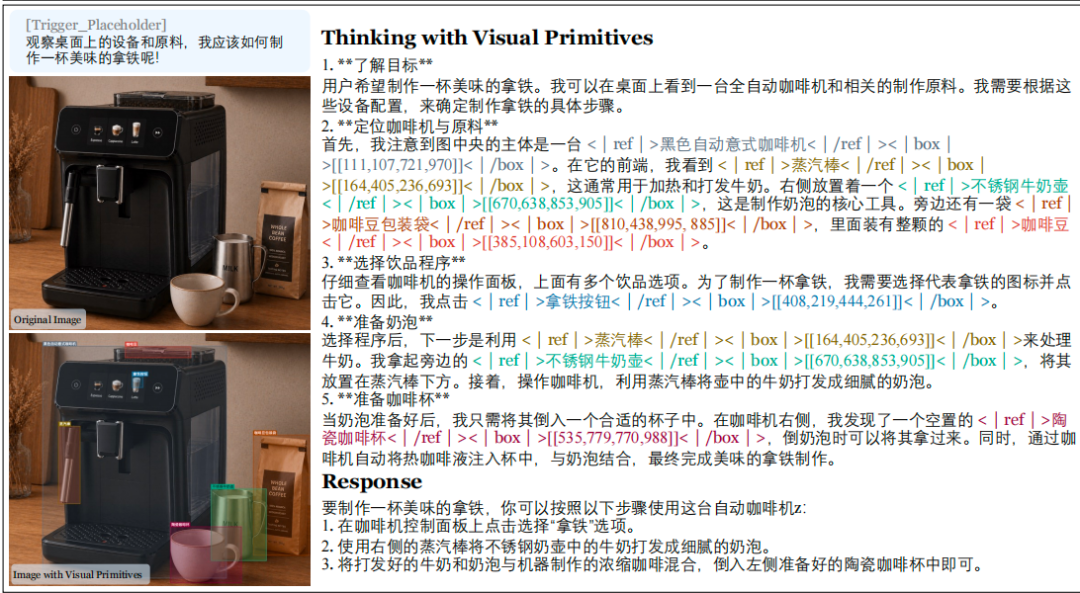

Er staat geen Chinees in de trainingsgegevens. Maar het model kan visueel primitief redeneren in het Chinees.

Geef hem een foto van een koffiezetapparaat en vraag 'Hoe maak je een latte' in het Chinees. Het markeert de positiecoördinaten van het stoompijpje, de melkkan, de koffiebonen en de latte-knoppen in het Chinees en geeft vervolgens de bedieningsstappen weer. Meertalige vaardigheden worden geërfd van het basismodel en worden niet vernietigd door training in visuele primitieven.

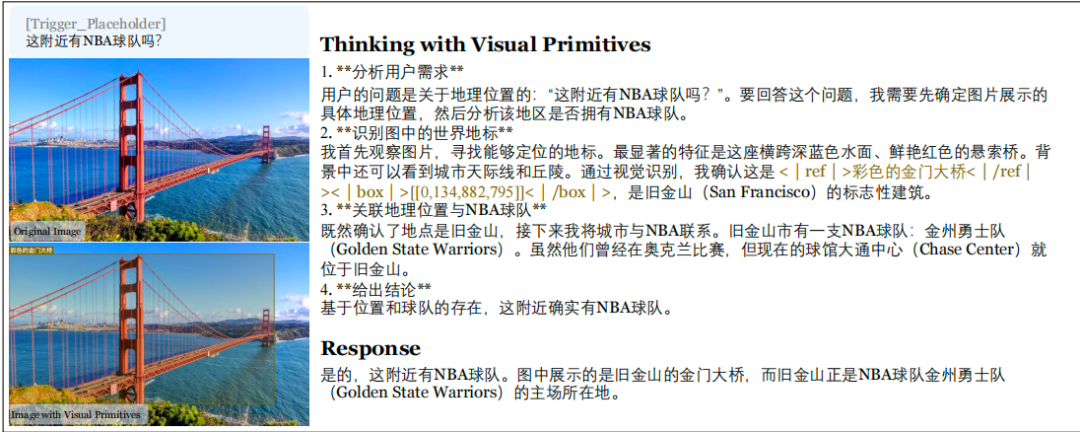

Het kan het bekijken van foto's ook combineren met kennis van de wereld: geef een foto van de Golden Gate Bridge en vraag "Is er een NBA in de buurt?" Team?" Het omlijstte de Golden Gate Bridge, redenerend dat het San Francisco was, en antwoordde vervolgens de Golden State Warriors.

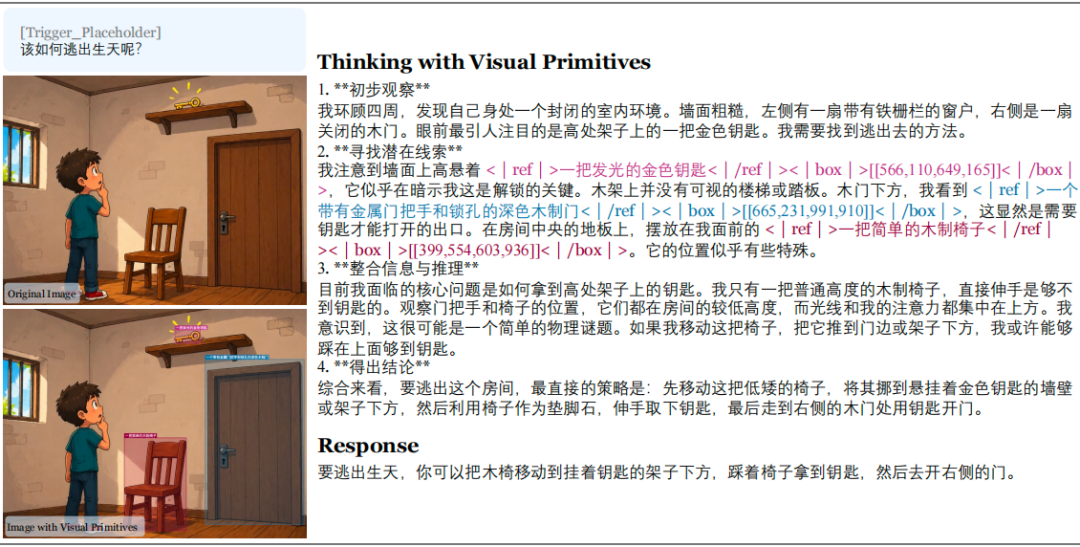

kan humor begrijpen: de natuurlijke vlekken op een afgesneden stuk fruit vormen precies het gezicht van een verdrietige kat, en het model kan de overeenkomsten benadrukken en uitleggen waarom het grappig is.Kan begeleiding bieden in de escape room: plaats de sleutel hoog, de stoel op de grond en de gesloten deur, en stel voor: "Verplaats de stoel onder de sleutel → stap erop om de sleutel te pakken → open de deur."

De krant schrijft openhartig over dingen die momenteel onmogelijk zijn.

De invoerresolutie is beperkt. De ViT-uitvoer zit vast tussen 81 en 384 visuele informatie-eenheden. Bij zeer gedetailleerde scènes (zoals het tellen van vingers) is de coördinatennauwkeurigheid niet voldoende. Dit zou de directe reden kunnen zijn waarom de auto eergisteren tijdens het tellen op de vingers tijdens de daadwerkelijke test over de kop sloeg.

Vereist momenteel een specifiek triggerwoord om de visuele primitieve modus te activeren. Het model kan nog niet zelf beoordelen: "Ik moet mijn vingers uitstrekken om dit probleem op te lossen", moet iemand het eraan herinneren.

Topologisch redeneren heeft beperkte generalisatiemogelijkheden. Het effect is goed op het getrainde doolhoftype, maar kan afnemen bij het overschakelen naar een nieuwe ruimtelijke structuur. Chen Xiaokang zei ook in die verwijderde tweet:

"We bevinden ons nog in de beginfase; generalisatie in complexe topologische redeneringstaken is nog niet perfect, maar we zijn vastbesloten om het op te lossen."

"We bevinden ons nog in de beginfase, en de generalisatie van complexe topologische redeneringstaken is dat nog niet compleet, maar we zullen het blijven oplossen.”

Tijdens de daadwerkelijke test eergisteren werden de mogelijkheden gedemonstreerd door de beeldherkenningsmodus van DeepSeek (vragen om de identiteit van de uitgever, het Lenovo walvislogo), wat betekent: zelfcorrectie, jezelf een "mini-verdedigingsbijeenkomst" geven), wat consistent is met de manier van denken die in dit artikel wordt beschreven. Het vestigt een visueel ankerpunt in de hersenen, redeneert rond het ankerpunt en gaat terug om het te corrigeren wanneer er conflicten optreden.

En het tellen van mijn vingers maakt me duizelig, dit is de levende demonstratie van Reference Gap. In het beeld van overlappende vingers is het puur vertrouwen op verbale beschrijvingen om ‘de derde van links’ en ‘de tweede van rechts’ te onderscheiden hetzelfde als het tellen van een groep mensen die op elkaar zijn gedrongen zonder je vingers uit te strekken, wat gedoemd is tot chaos.

De richting waarin dit artikel wijst is: de volgende evolutie van multimodaal redeneren ligt in het ankermechanisme. DeepSeek gebruikt 90 informatie-eenheden om het effect te evenaren van anderen die duizenden tokens gebruiken, en alle bespaarde rekenkracht wordt gebruikt om het model 'tegelijkertijd te laten denken en wijzen'.

De resolutie-wapenwedloop kan een beetje worden vertraagd door het model te leren zijn vingers uit te steken in plaats van hem een duurdere bril op te zetten.

Nadat de walvis zijn ogen opende, kreeg hij ook vingers. De nauwkeurigheid van het doolhof van 66,9% is verre van perfect, maar het neemt het tenminste serieus, in tegenstelling tot de jongens van de buren die een munt opgooien.