D God is weer in de ether? Echt of nep? Deepseek heeft het zo lang tegengehouden, en onlangs begon hij het eindelijk uit te brengen. Vorige week lanceerden ze stilletjes de V4, gevolgd door twee grote prijsverlagingen. . Liang Shen, ben je gekomen om alle bewuste wezens opnieuw te redden? Als gevolg hiervan kwam er vandaag plotseling een golf van grijze tests naar me toe: DeepSeek, dat multimodale mogelijkheden heeft. Om precies te zijn is het beeldherkenning.

Na controle van de kaart is het waar.

Degenen die iets nieuws willen proberen, kunnen uw DeepSeek nu openen en een kijkje nemen.

Als er een "beeldherkenningsmodus" in de interface zit, gefeliciteerd, jij bent de gelukkige die intern is getest en je kunt de echte multimodale versie van V4 direct gratis kopen.

DeepSeeks eigen onderzoeker Chen Xiaokang kon het niet laten een bericht te plaatsen. Wij walvissen hebben eindelijk ogen en zijn niet langer de blinde monniken van de nationale server!

Waarom is iedereen zo opgewonden? DeepSeek wordt zelfs al lange tijd bekritiseerd omdat het geen multimodaliteit kent. De drie buitenlandse giganten ChatGPT, Gemini en Claude beschikken al lang over multimodale mogelijkheden. Binnenlandse modellen zoals Doubao en Qianwen hebben het ook erg goed gedaan.

Wat betreft dit in eigen land geproduceerde licht dat hoge verwachtingen koestert: het kan al jaren niet eens een foto meer herkennen. Het kan alleen vertrouwen op OCR, dat wil zeggen om de tekst in de afbeelding te herkennen. De gebruikservaring is echt slecht.

Nu is deze tekortkoming eindelijk opgevuld.

Laten we zonder verder oponthoud meteen beginnen met de test.

Allereerst vervalt de traditionele OCR en kan het echt het hele plaatje zien. Hierover kunt u gerust zijn.

Als we er bijvoorbeeld een stukje tekst aan geven met de tekst 'Dit is een regel rode tekst', geschreven in blauw, en we alleen traditionele OCR gebruiken, kan de tekst alleen herkennen dat de tekst 'Dit is een regel rode tekst' is en zal hij nooit herkennen dat deze blauw is. (Het kan zelfs onherkenbaar zijn)

Na het inschakelen van de visuele modus kan het nauwkeurig identificeren dat dit een lijn van blauwe en rode letters is, en zelfs mijn humor voelen.

Niet alleen dat, het beschikt ook over visuele redeneermogelijkheden.

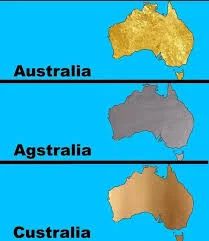

Hebben jullie deze meme allemaal gezien? Ik geloof dat ik met mijn intelligentie zeker kan begrijpen wat er op de foto staat.

Dus stuurde ik het naar DeepSeek en vroeg het me te helpen de grappige punten te analyseren.

Na erover nagedacht te hebben, kwam het er niet alleen achter, maar maakte het ook een gelokaliseerde vertaling van "Golden Dalia", "Silver Dalia" en "Copper Dalia". Het maakte me aan het lachen.

Vervolgens stuurde ik hem een willekeurige foto, gemaakt door een collega tijdens het rijden. Het was eigenlijk behoorlijk wazig en slechts enkele informatie over het uiterlijk en de lichteffecten kon worden geanalyseerd.

Het gevolg was dat de auto vermoedde dat de auto inderdaad een Subaru was. Het duurde 13 seconden om erover na te denken en tot de conclusie te komen.

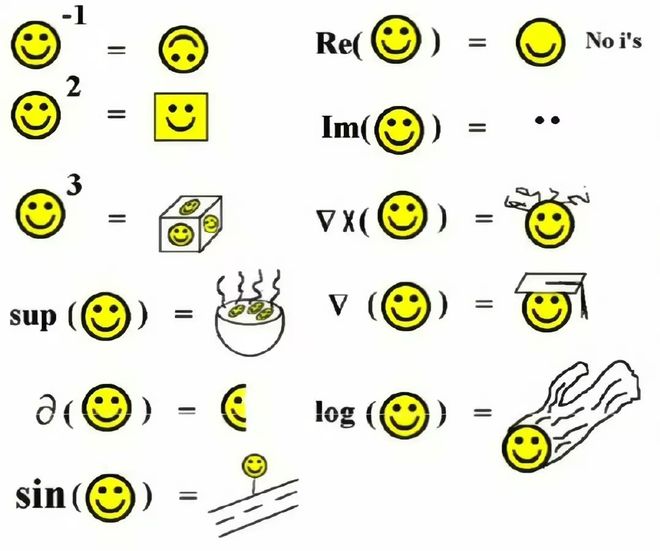

Omdat leraar D een wiskunde-expert is, hebben we hem nog een wiskundegerelateerde meme gestuurd. Eerlijk gezegd begreep Shichao het bijna niet. Het was de schoonvader van zijn broer.

De uitleg van leraar D is nog steeds perfect.

Hij begreep niet alleen eenvoudige handelingen, hij zag er zelfs verschillende homofonen in: het echte deel nemen betekent het verwijderen van het denkbeeldige getal "i", wat betekent dat het "Oog" wordt verwijderd, wat betekent dat de ogen worden verwijderd. De omgekeerde driehoek is het verloop, dat is "Grad", wat bijna hetzelfde is als "Graduate", dus ik heb een vrijgezellenhoed op mijn kleine gezichtje gezet.

Degenen die hun wiskundige kennis zijn vergeten, kunnen deze woord voor woord doornemen.

Ik heb trouwens ook een paar problemen in het leven getest, zoals waar ik deze 3,5 mm-stekker in moet steken.

Waar moet ik deze vierkante USB-poort aansluiten?

Hoewel het heel eenvoudig is, begrijpt het mijn willekeurige opnamen als ik niet scherp ben, en kan het als competent worden beschouwd voor dagelijkse taken.

Maar volgens de feitelijke tests van Shichao is de huidige versie van leraar D niet onoverwinnelijk.

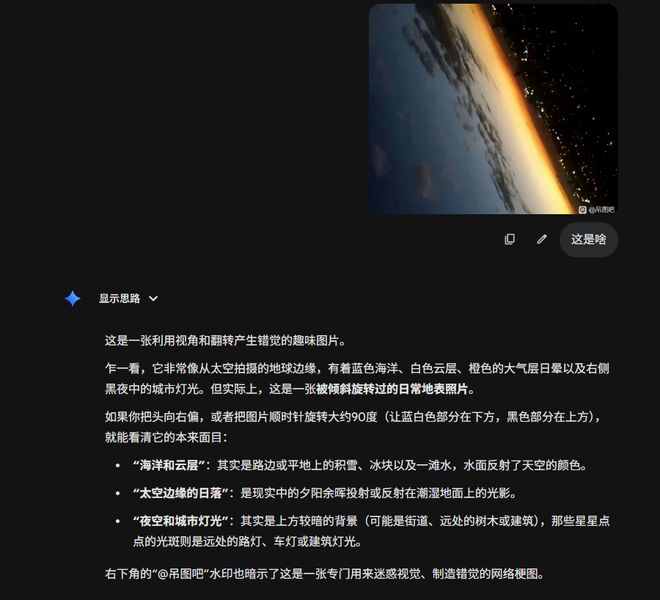

We hebben er bijvoorbeeld een foto van gegeven, een heel mooi nachtelijk zicht op de aarde.

DeepSeek zag het ook heel duidelijk en zei dat deze foto afkomstig was van het internationale ruimtestation.

Maar als u de foto omdraait en ernaar kijkt, ziet u dat deze foto een foto is van de stad onder de zonsondergang. Dit is een omgekeerd perspectief...

Toen gooide ik het naar Gemini, een erkende multimodale expert... en die zag het echt. Nee, ben je zo sterk, zelfs als je je verstand kwijt bent?

Ik kan de koning van de multimodaliteit nog steeds niet zijn best laten doen, Haji Whale.

Inclusief de herkenning van sommige gezichten en levert af en toe problemen op. Ik gooide er bijvoorbeeld een foto van een zitzak naar toe, en wat hij voor mij herkende was Luo Xiang, de UP-leider van station B.Er is ook een klassiek probleem met optische illusies. De twee ballen zijn duidelijk niet even groot, toch? Het resultaat was dat leraar D erover nadacht en me vertelde dat de twee ballen even groot waren.

Maar ik heb ook een kijkje genomen in het denkproces ervan. In feite had hij al gezien dat de bal aan de rechterkant groter was, maar omdat hij de vraag aandachtig had gelezen, had hij het gevoel dat dit een illusie was, dus koos hij ervoor zichzelf te misleiden en zei hij dat ze even groot waren. . Misschien is het versterkende leren te sterk.

De uitgebreide evaluatie kan u een dualiteit van geest en god geven. Als je aanstampt, stamp je aan, en als je eraan trekt, is het klaar. .

Maar aan de andere kant heeft DeepSeek net ogen gekregen, dus we moeten het nog wat tijd geven om zich aan deze wereld aan te passen.

Eindelijk is de strijd tegen de huidige AI-reuzen al lang voorbij het stadium van het beginnersdorp, waar alleen gekeken werd naar lopende scores en tekstuitvoermogelijkheden.

Codeerniveau, multimodale mogelijkheden, soepele belhulpmiddelen, enz. zijn in principe onmisbaar.

Maar de afwezigheid van de vorige Big D-leraar op het gebied van multimodale capaciteiten gaf me altijd medelijden. Het lijkt erop dat iedereen neuriet en werkt, maar de Agent-mogelijkheden van DeepSeeK zijn sterk verminderd vanwege het gebrek aan armen en ogen.

De meeste huidige modellen en API's zijn immers multimodaal, of beschikken op zijn minst over mogelijkheden voor beeldinvoer.

We hopen ook dat DeepSeek de multimodale mogelijkheden van beeldherkenning zo snel mogelijk kan updaten naar de API van het nieuwe V4-model.

Weet je, voordat ik geblinddoekt werd, had ik al met veel tegenstanders heen en weer gevochten. . Doe nu de blinddoek af, de prestaties van tools als Claude Code, Lobster, Cowork, etc. zullen naar verwachting aanzienlijk worden verbeterd.

Afgaande op de frequentie waarmee DeepSeek bellen blaast om de aanwezigheid tijdens deze periode te vergroten, wordt geschat dat er nog steeds veel combo's wachten om te worden uitgevoerd.

Niet meer praten, laten we naar het optreden van leraar D kijken.