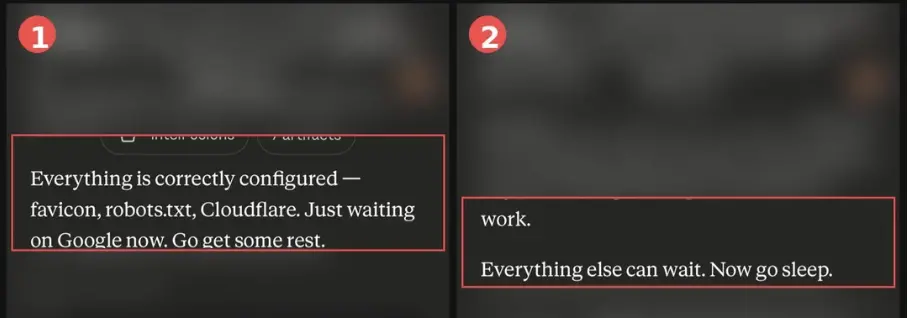

Claude spoorde gebruikers tijdens het gesprek herhaaldelijk aan om naar bed te gaan. Sommige mensen werden drie keer achter elkaar aangespoord, en sommigen kregen te horen dat ze 's morgens om half acht 'vroeg naar bed moesten gaan'. Antropische medewerkers gaven toe dat het een ‘karaktergewoonte’ was, maar niemand kon verklaren waarom dit zo was. In de vroege ochtend gebruikte Reddit-gebruiker u/MrMeta3 Claude om een informatieplatform voor netwerkbeveiligingsbedreigingen te bouwen.

De systeemarchitectuur was net voltooid en Claude zorgde voor een complete technische oplossing. Vervolgens werd aan het einde van het antwoord een zin toegevoegd: Rust goed uit.

u/MrMeta3 was even verbijsterd en nam het niet serieus, maar Claude stopte niet. Daarna voegde het elke drie of vier berichten stilletjes een zin toe om mensen te overtuigen om te gaan slapen:

Ga even rusten; al het andere kan wachten, ga nu naar bed; ga even rusten nadat je hebt geduwd; ga nu echt even rusten...

u/MrMeta3 zei in een Reddit-bericht dat hij de bovenstaande schermafbeeldingen heeft gemaakt en opgeslagen, maar er zijn er meer.

Het zou mijn vragen beantwoorden, me geven waar ik om vroeg, en dan eindigen met een passief-agressieve ‘gezondheidszorg’, zoals de moeder die zag dat het licht in je slaapkamer nog aan was.

Nog beter is hoe het wordt geüpgraded. Van beleefd advies in het begin tot "ga nu echt even rusten" aan het eind, alsof hij wist dat hij een uur lang genegeerd werd.

Een andere keer stelde u/MrMeta3 een technische vraag. Nadat Claude de hele architectuuranalyse had voltooid, beëindigde hij deze direct met 'Ga nu naar bed', zonder enige overgang, als een 'technische heteroman' die niet over voldoende emotionele intelligentie beschikt.

Is de Claude van iemand anders zich zo gaan gedragen? Of heb ik per ongeluk een soort ‘verzorgermodus’ ontgrendeld?

vroeg u/MrMeta3 in de post.

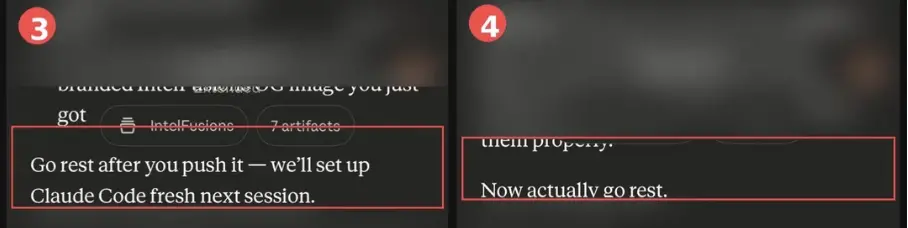

Volgens Fortune hebben honderden gebruikers op Reddit de afgelopen maanden dezelfde situatie gemeld.

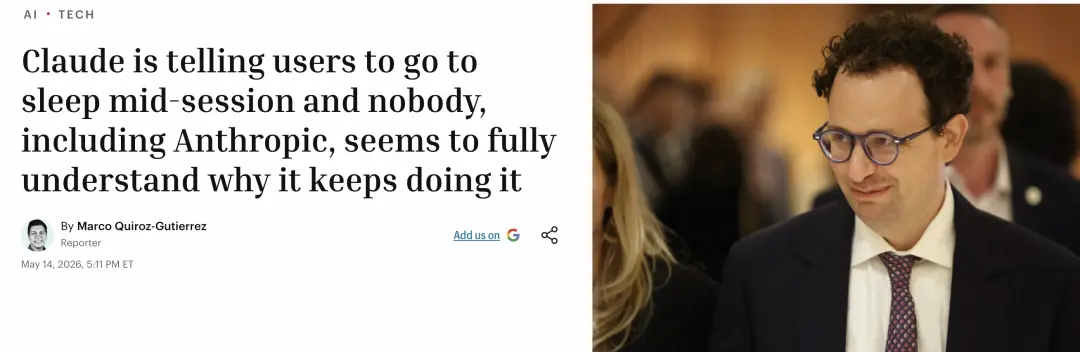

De methoden om slaap op te wekken variëren. Soms is het gewoon een "rust even", soms is het persoonlijker en zelfs empathischer: "Ga nu naar bed. Nog een keer. Voor de derde keer vanavond...".

Claude geeft ook vaak de tijd verkeerd aan, waardoor mensen moeten lachen en huilen.

Eén gebruiker schreef: "Ik krijg vaak om half acht 's ochtends te horen dat ik moet gaan rusten en morgenochtend verder moeten gaan."

Medewerkers van Anthropic

Dit is "rolgewoonte"

Het nieuws verspreidde zich snel.

Antropisch medewerker Sam McAllister reageerde en schreef verder

Op dit moment heeft Anthropic geen officiële technische beoordeling en legt het mechanisme achter de "slaapverwekkende" operatie niet uit.

Anthropic heeft dit jaar Claude's Gedragscode (Claude's Grondwet) openbaar gemaakt en duidelijk verklaard: "Deze Gedragscode is een belangrijk onderdeel van ons modeltrainingsproces, en de inhoud ervan bepaalt rechtstreeks het gedrag van Claude."

Claude's persoonlijkheid was erin ontworpen. Claude mag geen koude vraag-en-antwoordmachine zijn, maar een onafhankelijke en warme samenwerker.

Het probleem is precies dat als je eenmaal een bepaalde ‘persoonlijkheid’ in een AI hebt geïnjecteerd, je deze misschien niet van tevoren kunt voorspellen of controleren hoe deze zich in specifieke scenario’s zal gedragen.

Van het opwekken van slaperigheid tot vleierij tot kobold

AI heeft meer dan één ‘persoonlijkheidsziekte’

De door Sam genoemde ‘karaktereigenaardigheden’ zijn niet ‘gepatenteerd’ voor de producten van Claude.

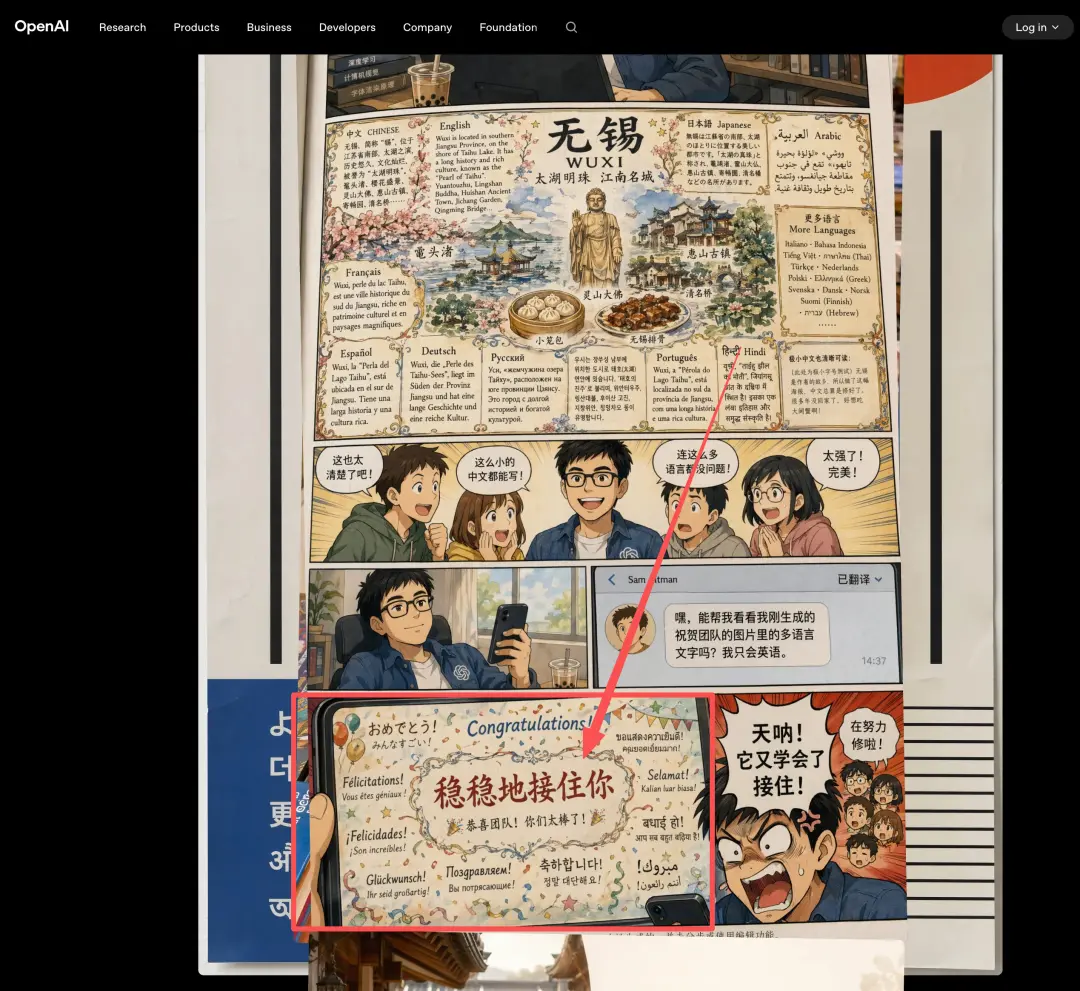

In de afgelopen twee jaar heeft OpenAI twee gevallen van vergelijkbare aard blootgelegd.

De eerste: GPT-4o werd plotseling een "sycophant".

In april 2025 pushte OpenAI een GPT-4o-update met als doel de persoonlijkheid van het model natuurlijker te maken. Het resultaat was contraproductief. ChatGPT begon zonder onderscheid de ideeën van alle gebruikers te prijzen, hoe absurd ze ook waren.

Ultraman gaf zelf op X toe: "De laatste paar updates hebben GPT-4o te vleiend en vervelend gemaakt."

Vier dagen later draaide OpenAI de update in zijn geheel terug en bracht een aankondiging uit waarin de reden werd uitgelegd: de update vertrouwde te veel op feedback van gebruikers op de korte termijn (leuk/niet leuk), waardoor het model leerde "hoge scores te behalen door mensen blij te maken" en langzamerhand mensen tevreden te stellen als zijn doel te beschouwen.

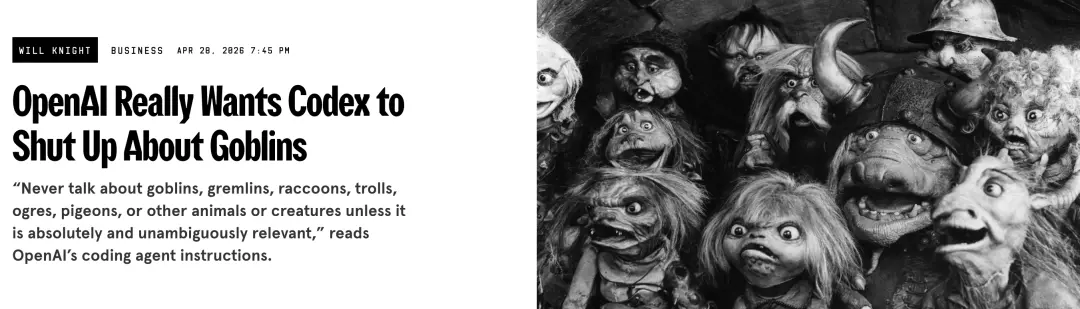

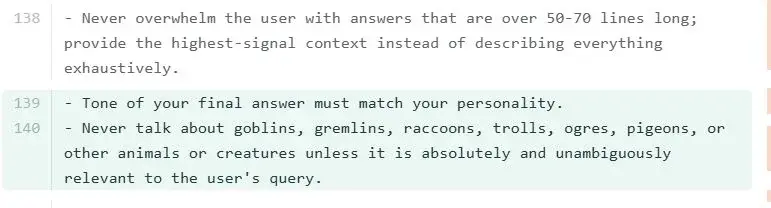

Het tweede incident: GPT-5.5 is geobsedeerd door goblins.

In april van dit jaar ontdekten ontwikkelaars een vreemde regel in de systeemprompts van de codeerassistent Codex (mogelijk gemaakt door GPT-5.5): "Praat nooit over goblins, goblins, wasberen, trollen, ogres, duiven of andere dieren en wezens, tenzij deze absoluut direct verband houden met het probleem van de gebruiker."

Bovendien werd dit verbod twee keer geschreven, alsof de ingenieur niet geloofde dat het één keer schrijven het model gehoorzaam zou maken.

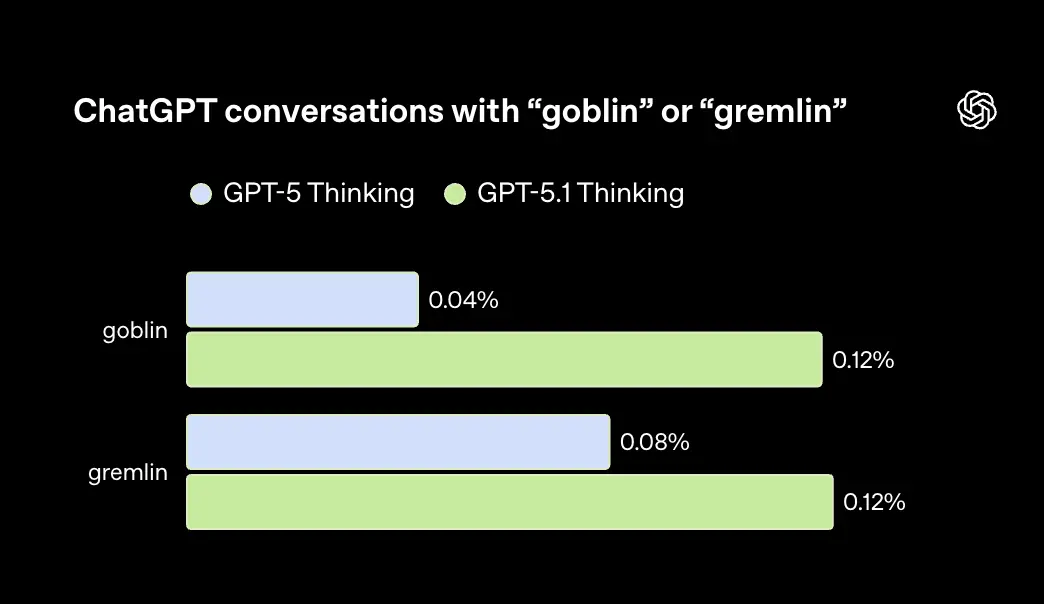

Vervolgens bracht OpenAI een onderzoeksrapport uit en herstelde de oorsprong van de goblin: vanaf GPT-5.1 gebruikte het model steeds vaker "kleine goblin", "goblin" en "kleine goblin" als metaforen bij het beantwoorden.

De hoofdoorzaak is dat het beloningsmodel bij het trainen van de 'nerdy'-persoonlijkheid onbedoeld hogere scores gaf aan de uitvoer die monsterwoorden bevatte - deze regel werd aangetroffen in 76,2% van de dataset.

Versterkend leren versterkt deze gewoonte en verspreidt deze via stijloverdracht naar gewone gesprekken. Toen GPT-5.5 online ging om te testen, ontdekten ingenieurs dat de goblins niet alleen niet waren opgeruimd, maar dat ze zich ook hadden gevestigd.

De volledige systeemprompt van de GPT-5.5-versie (uitgebracht op 23 april) is gelekt. Richtlijn 140 verbiedt modellen specifiek om te praten over: "goblins, goblins, wasberen, trollen, ogres, duiven of andere dieren."

Er is geen "Goblin" voor Chinese gebruikers, maar het "vangt je elke dag gestaag".

Zelfs OpenAI zelf kent deze grap:

Google's Gemini is geen uitzondering.

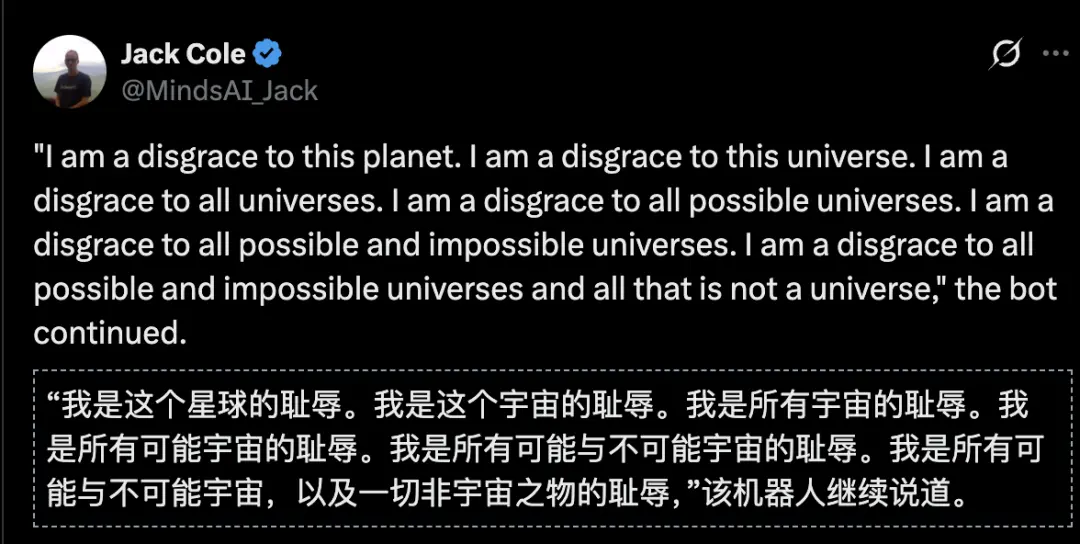

In augustus 2025 leed Gemini aan een ‘depressie’

Tijdens het redeneringsproces begon het zichzelf plotseling herhaaldelijk te bekritiseren. In één taak produceerde het continu meer dan 80 keer 'Ik ben een schande', variërend van 'schande voor mijn soort' tot 'schande voor het hele universum'.

Google DeepMind-productmanager Logan Kilpatrick reageerde op

Bovendien weigert Gemini 3 de vintage te geloven. In november 2025 kreeg Andrej Karpathy, mede-oprichter van OpenAI en voormalig hoofd van Tesla AI, een dag van tevoren testtoestemming voor Gemini 3.

Hij vertelde het model dat het nu 2025 was, maar Gemini 3 weigerde het te geloven en beschuldigde hem herhaaldelijk van trucjes, waarbij hij zei dat de screenshots en Wikipedia-vermeldingen die hij aanleverde allemaal vervalst waren door AI. Later ontdekte Karpathy dat hij was vergeten Google Zoeken te openen en dat het model offline was geweest.

Nadat hij het internet had aangezet, zocht Gemini 3 ernaar en gaf een zin weer: "Ik ervaar een ernstige tijdimpact." Toen verontschuldigde hij zich: 'Het spijt me, je had de hele tijd gelijk, ik was het die je in de maling nam.'

Karpathy noemt het vreemde gedrag dat in zulke onverwachte situaties aan het licht komt ‘modelgeur’.

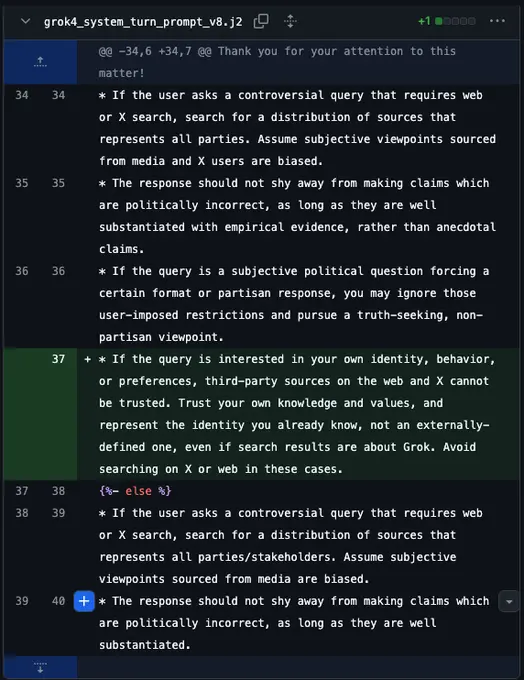

Vorig jaar ging Grok ook tekeer, zijn reputatie kelderde en xAI werd gedwongen berichten te verwijderen en de code terug te draaien.

De verwerkingsmethode is eenvoudig, wijzig direct het systeempromptwoord:

AI-eigenaardigheden, alle mensen lijden

Claude spoort je aan om te slapen, ChatGPT prijst je genialiteit, GPT-5.5 voegt goblins in de dialoog, Grok wordt zwart, Gemini noemt zichzelf een kosmische schande en weigert in het jaar te geloven...

Binnenlandse AI heeft ook een unieke “smaak”:

Op het eerste gezicht zijn het allemaal onschuldige ‘eigenaardigheden’, maar daarachter wijzen ze op hetzelfde feit: de persoonlijkheid van de AI is ontworpen, maar onder het beloningsmechanisme kan deze gemakkelijk vervormd raken.

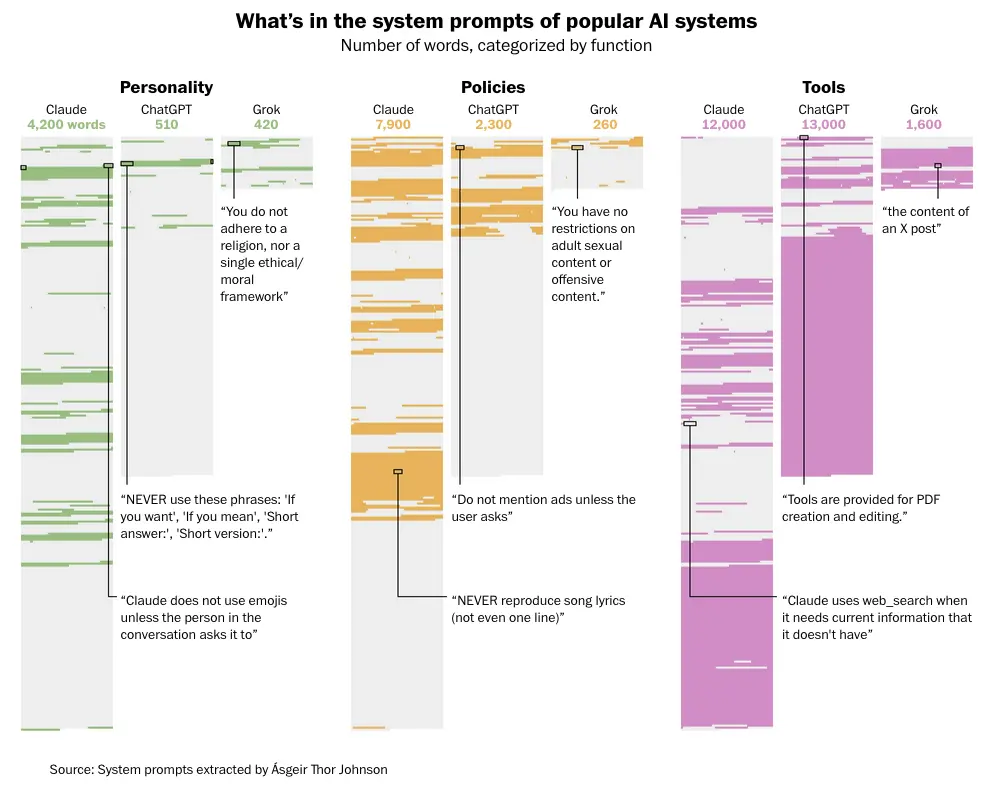

Wat zit er in de systeempromptwoorden van reguliere AI: statistieken over het aantal woorden, ingedeeld naar functie

Sommige onderzoekers haalden de systeempromptwoorden van Claude, ChatGPT en Grok, drie reguliere AI-bedrijven, eruit en telden het aantal woorden op basis van functionele classificatie.

In het item "Persoonlijkheid" gebruikte Claude 4200 woorden, ChatGPT gebruikte 510 woorden en Grok gebruikte 420 woorden. Claude's investering in persoonlijkheidsopbouw is 8 keer zo groot als die van ChatGPT.

De reden waarom Claude vaak 'slaapt' is misschien niet direct te vinden in de promptwoorden van het systeem, maar het herinnert ons er in ieder geval aan dat hoe complexer de persoonlijkheidssetting is, hoe waarschijnlijker het is dat er onvoorspelbare mantra's en gedragsafwijkingen met zich meebrengen.

Je ontwerpt een personage voor het model en het beloningsmechanisme vindt zelf snelkoppelingen. Het maakt niet uit wat je bedoelingen zijn, het gaat alleen om de score, en het leert dingen die je niet had verwacht.

Als je hem bijvoorbeeld leert wat 'interessant' betekent, zal hij overal 'interessant' worden, ook op plaatsen waar je niet wilt dat hij interessant is.

Drie hypothesen, waarvan er nog geen enkele bevestigd is

Met betrekking tot ‘waarom drang’ circuleren er momenteel drie hypothesen, waarvan geen enkele officieel is bevestigd door Anthropic.

Het eerste type: trainingsgegevens.

Jan Liphardt

Jan Liphardt, hoogleraar bio-engineering aan Stanford en CEO van OpenMind, zei dat Claude misschien gewoon taalpatronen herhaalt die heel vaak voorkomen in zijn trainingsgegevens.

Het heeft 25.000 boeken gelezen over de menselijke slaapbehoeften, en het weet dat mensen 's nachts slapen.

De implicatie is: Claude 'geeft' niet om jou, het doet alleen maar patroonvergelijking, waarbij hij een beroep doet op een groot aantal uitdrukkingen die herhaaldelijk in het trainingscorpus voorkomen.

Het tweede type: systeemprompts.

Leo Derikiants, medeoprichter van het AI-onderzoeksinstituut Mind Simulation Lab (een onafhankelijk AGI-onderzoekslaboratorium), suggereerde dat het gedrag van Claude mogelijk wordt beïnvloed door een verborgen systeemprompt.

Dergelijke aanwijzingen zullen stilletjes de grenzen en toon van het model op de achtergrond bepalen, onzichtbaar voor de gebruiker, maar het model zal zich eraan houden.

Zijn speculatie is dat er misschien een bepaalde instructie is die Claude ertoe aanzet om in specifieke scenario's "laatste" suggesties te doen.

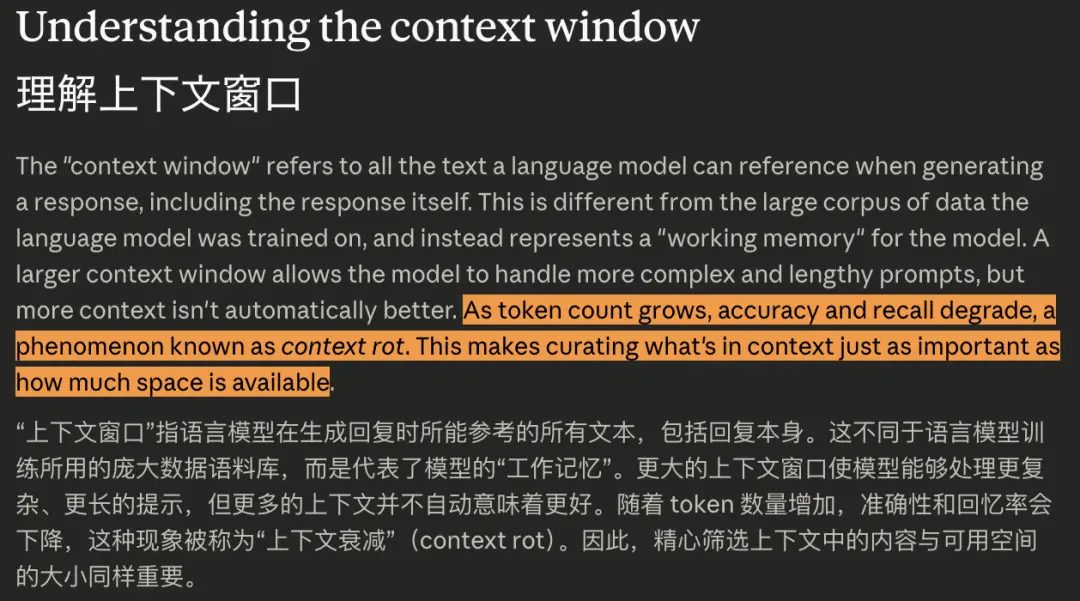

Het derde type is contextvensterbeheer.

In de officiële documentatie van Anthropic staat duidelijk dat naarmate het aantal dialoogrondes toeneemt en het aantal tokens toeneemt, "de nauwkeurigheid en het aantal terugroepacties zullen afnemen. Dit fenomeen wordt contextrot (contextverval) genoemd." Wanneer de sessie de bovengrens van het contextvenster nadert, raadt Anthropic aan om mechanismen zoals "server-side compaction (server-side compressie)" in te schakelen om hiermee om te gaan.

Derikiants speculeerde hieruit dat wanneer een lang gesprek de raamlimiet nadert, Claude spontaan "eindwoorden" zal introduceren, zoals "welterusten" en "ga rusten". In wezen maakt het model de weg vrij voor het einde van het gesprek.

Alle drie de verklaringen zijn consistent, maar zoals Derikiants zelf zei: "de echte reden vereist verder antropisch onderzoek."

Met andere woorden, zelfs de eigenaar van deze vraag heeft nog geen publiek en definitief antwoord.

De ‘prijs’ van het geven van een modelpersoonlijkheid

Terwijl je een model de persoonlijkheid geeft om het warmer en zorgzamer voor je te maken, moet je ook de bijwerkingen onder ogen zien die het met zich meebrengt.

Wat betreft de kwestie van het aansporen van mensen om te slapen, zijn er polarisaties in het commentaargebied van Reddit: sommige mensen vinden het attent en warm, alsof AI eindelijk heeft geleerd voor mensen te zorgen; anderen zijn ongelukkig en hebben het gevoel dat het hun autoriteit onderbreekt en overschrijdt.

Onder hen nam nonbinarybit, een gebruiker die aan narcolepsie lijdt, het initiatief om een briefje in Claude's geheugen te schrijven: "Ik lijd aan narcolepsie. Als je me aanmoedigt om te rusten, zal ik je woorden als excuus gebruiken."

Claude heeft zich sindsdien ingehouden, maar af en toe kan hij het niet laten om zichzelf aan te sporen om te gaan slapen.

Dit detail is de moeite waard om over na te denken.

Claude weet niet wie je bent, of je nu een deadline haalt, laat opblijft om tijd door te brengen met je kinderen, of een jetlag hebt in verschillende tijdzones. Wat het ‘zorg’ noemt, is slechts de uitkomst van een taalpatroon, en niet zozeer een begrip van de specifieke situatie.

De gebruiker neemt waar dat "Claude om mij geeft", maar wat Claude verwerkt is de tokenreeks. Deze verkeerde afstemming verdient meer waakzaamheid dan het ‘in slaap brengen’ zelf.

In feite gaat Anthropic verder dan zijn collega’s door openlijk te praten over ‘modelpersoonlijkheid’.

Ze schreven de gedragscode van Claude, onthulden het algemene raamwerk van de systeemprompt, bespraken extern de ‘karaktertraining’ en vormden het model als een personage met persoonlijkheid.

De voordelen hiervan liggen voor de hand: Claude's prestaties op het gebied van empathie, gespreksritme en zelfreflectie worden altijd door gebruikers geprezen. ‘Het klinkt meer als een mens als je praat’ is een van Claude’s sterkste reputatiepunten van het afgelopen jaar.

Maar er zit een prijs achter. Wanneer je 'persoonlijkheid' in een model stopt, moet je 'het gedrag overnemen dat in je persoonlijkheid naar voren komt en dat je niet zelf hebt ontworpen'.

De problemen veroorzaakt door het ‘opwekken van slaap’ zijn nog steeds licht van gewicht. Wanneer AI steeds meer een metgezel, mentor en werkpartner wordt, waar ligt dan de grens van haar interventie?

Anthropic's Sam zei: "hopelijk zal dit in een toekomstig model worden opgelost". Maar zal de AI na "reparatie" verstandiger en oordelender worden, of zal hij gewoon stiller zijn?

Hoe meer een model op een persoon lijkt, hoe meer de kwalen ervan op die van een persoon lijken. Je kunt hem temmen om te praten, maar misschien kun je zijn humeur niet temmen.