Google heeft voor het eerst bekendgemaakt dat zijn beveiligingsteam tijdens een aanhoudende cyberaanval een zero-day-exploit heeft ontdekt en met succes heeft geblokkeerd, vermoedelijk ontwikkeld door kunstmatige intelligentie. Volgens een rapport van de Google Threat Intelligence Group (GTIG) werd de aanval georkestreerd door een "bekende cybercriminele bedreigingsacteur" in een poging een "grootschalige exploitatiegebeurtenis" te lanceren en zich te richten op een niet nader genoemde "open source, webgebaseerde systeembeheertool" en deze te gebruiken om het tweefactorauthenticatiemechanisme (2FA) van het platform te omzeilen.

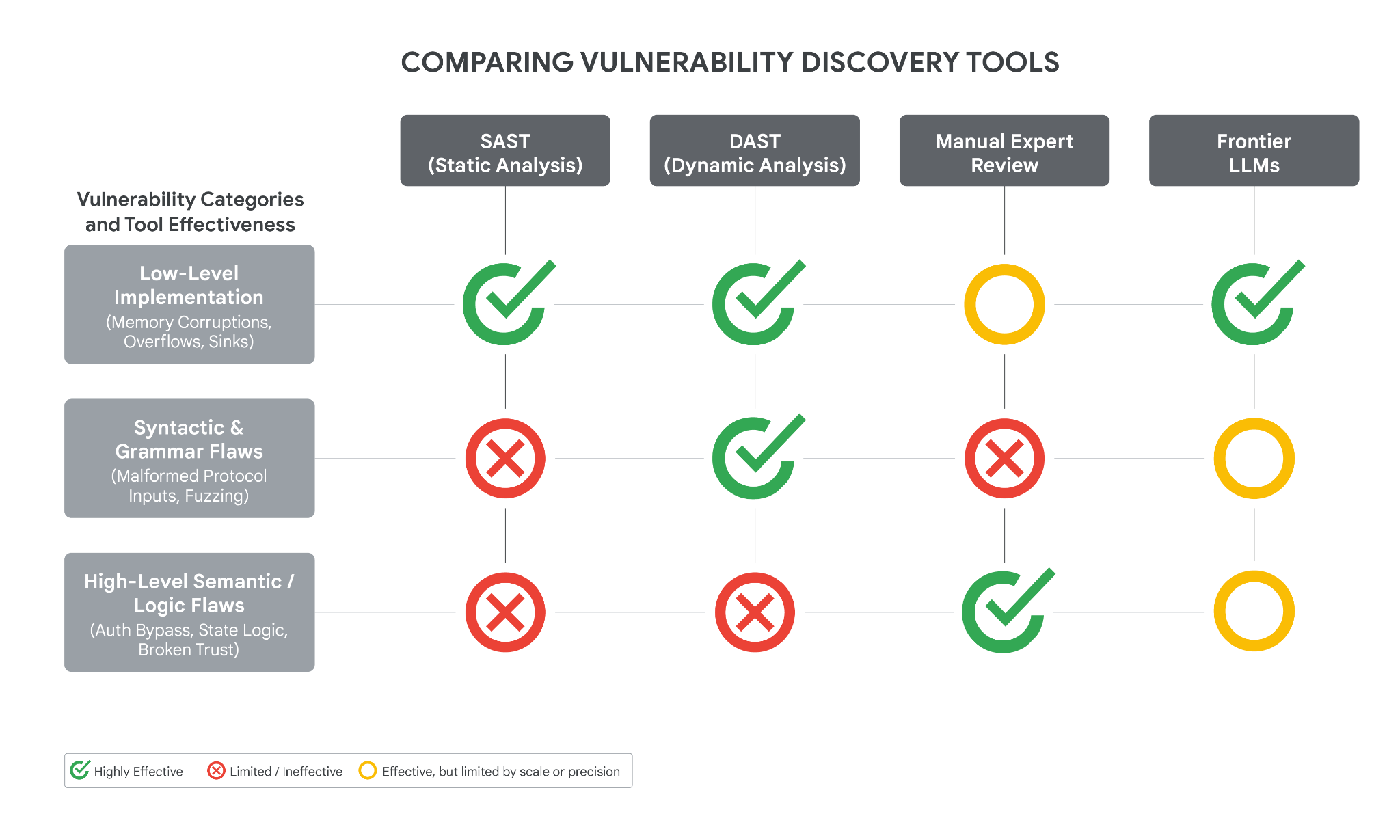

Google-onderzoekers vonden meerdere aanwijzingen in het Python-exploitscript dat werd gebruikt om de aanval uit te voeren en waarvan werd vermoed dat ze door AI waren gegenereerd, waaronder een ‘illusoire CVSS-score’ en een algemene, schoolboekachtige gestructureerde lay-outstijl. Deze functies lijken sterk op de gebruikelijke trainingsgegevensformaten van grote taalmodellen. Het rapport stelt dat de kwetsbaarheid in wezen een ‘semantische logische fout op hoog niveau’ is, veroorzaakt door ‘het hard coderen van een vertrouwensaanname’ in het 2FA-ontwerp van het platform, waardoor aanvallers een toegangspunt krijgen dat kan worden versterkt door geautomatiseerde tools.

Het incident vond plaats in een tijd waarin de industrie hevig debatteert over de mogelijkheden van AI-modellen gericht op cyberbeveiligingsscenario's, zoals het Mythos-model gelanceerd door Anthropic, en een recente AI-ondersteunde ontdekking van een kwetsbaarheid in de Linux-kernel, die allemaal hebben geleid tot voortdurende aandacht voor de rol van AI bij zowel aanval als verdediging. Google zei dat dit de eerste keer is dat het duidelijk bewijs heeft gevonden dat AI direct betrokken is bij het misbruik van kwetsbaarheden bij een daadwerkelijke aanval, maar het onderzoeksteam wees er ook op dat het momenteel “niet gelooft dat Google’s eigen Gemini-model bij deze aanval is gebruikt.”

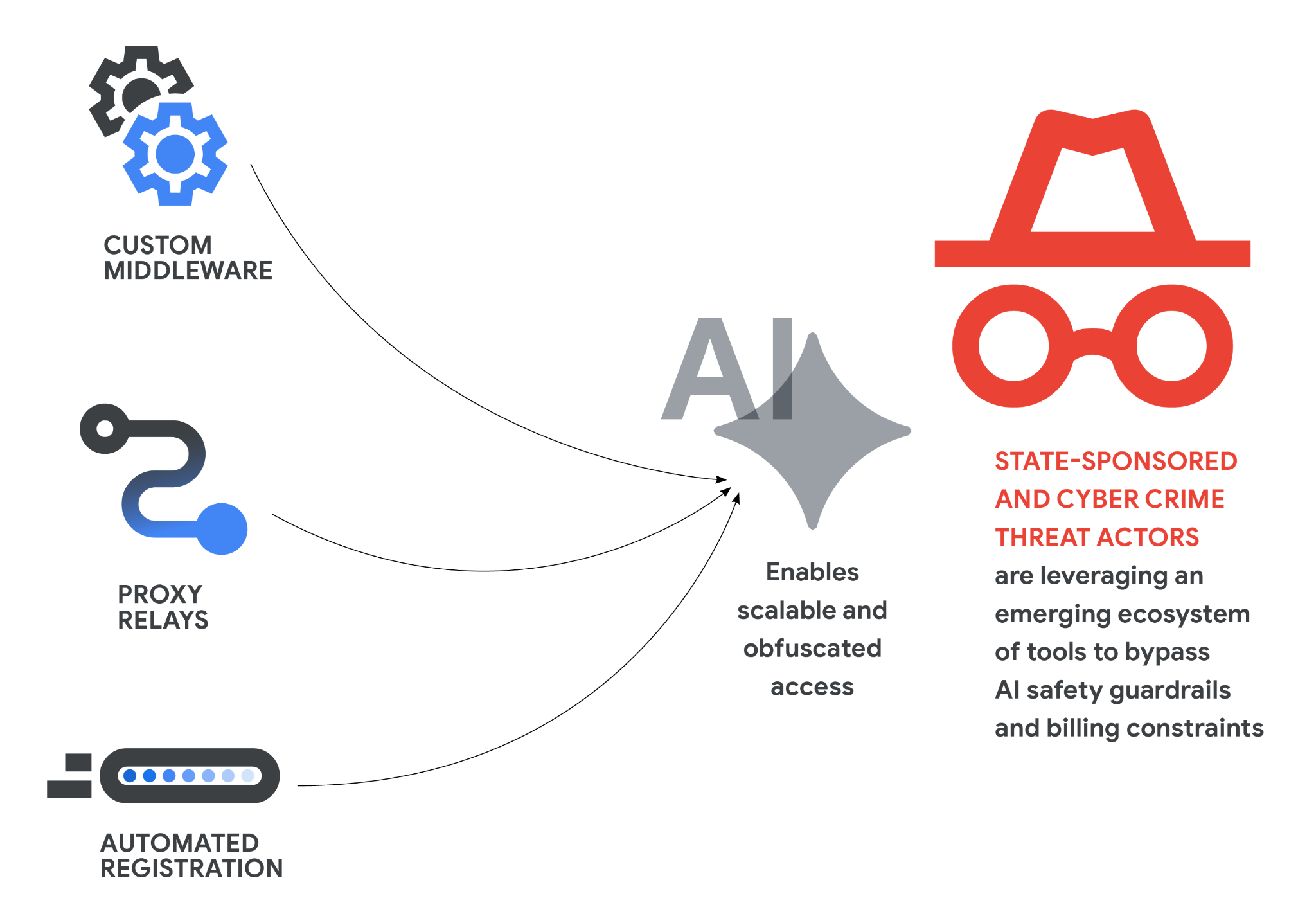

Google zei dat het deze specifieke aanval met succes had ‘verstoord en geblokkeerd’, maar waarschuwde ook dat hackers steeds systematischer AI gebruiken om beveiligingskwetsbaarheden te ontdekken en te exploiteren, en dat de automatisering zich versnelt van het vroegtijdig verzamelen van inlichtingen tot het opsporen van kwetsbaarheden en het schrijven van exploitcodes. Het rapport herinnert er ook aan dat het AI-systeem zelf en zijn ecosysteem ook een nieuw aanvalsoppervlak aan het worden zijn: aanvallers beginnen zich te richten op meer geïntegreerde componenten die mogelijkheden bieden voor AI, zoals externe toolinterfaces en dataconnectors van derden die taken autonoom uitvoeren, om nieuwe inbraakpaden te vinden.

Naast het gebruik van AI om aanvalscode te schrijven, noemde Google in het rapport ook een soort verspreidingstechniek: ‘persoonlijkheidsgedreven jailbreak’. De aanvaller zal zorgvuldig promptwoorden construeren om het model te laten 'optreden' als een senior beveiligingsonderzoeker of expert op het gebied van penetratietests, waardoor het model inhoud zal produceren die door het beveiligingsbeleid zou moeten worden onderschept, inclusief het helpen bij het lokaliseren van potentiële beveiligingskwetsbaarheden in het systeem of het genereren van exploitatie-ideeën. Google benadrukte dat dit soort aanvalspatronen laat zien dat de rol van AI op het gebied van netwerkbeveiliging snel evolueert van een eenvoudig defensief instrument naar een nieuwe ‘multiplier’ voor zowel aanval als verdediging. In de toekomst zullen dergelijke zero-day-aanvallen waarbij AI nauw betrokken is, wellicht geen uitzondering meer zijn.