Op 24 april werd de preview-versie van DeepSeek-V4 officieel uitgebracht en tegelijkertijd open source. beweert het leidende niveau te hebben bereikt op nationaal en open source-gebied in de drie dimensies van Agent-capaciteiten, wereldkennis en redeneerprestaties. DeepSeek-V4 is verdeeld in twee versies, Pro en Flash, die beide een ultralange context van miljoenen (1 miljoen) tokens ondersteunen. Beide versies verminderen de computer- en grafische geheugenvereisten aanzienlijk, waardoor het aantal inferentie-FLOP's per tag met 73% wordt verminderd en het KV-cachegeheugengebruik met 90% wordt verminderd.

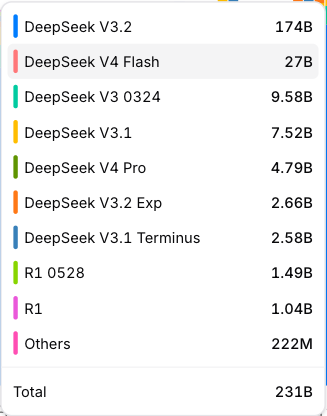

Op 24 april lieten gegevens van OpenRouter, 's werelds grootste aggregatieplatform voor AI-modelapplicatieprogrammeringsinterfaces, zien dat het aantal oproepen naar V4-Flash 27 miljard tokens bedroeg, en dat van V4-Pro 4,79 miljard tokens, maar ze verschenen niet in de ranglijst.

Na de release van DeepSeek-V4 voerden reguliere evaluatieplatforms capaciteitstesten en ranglijsten uit.

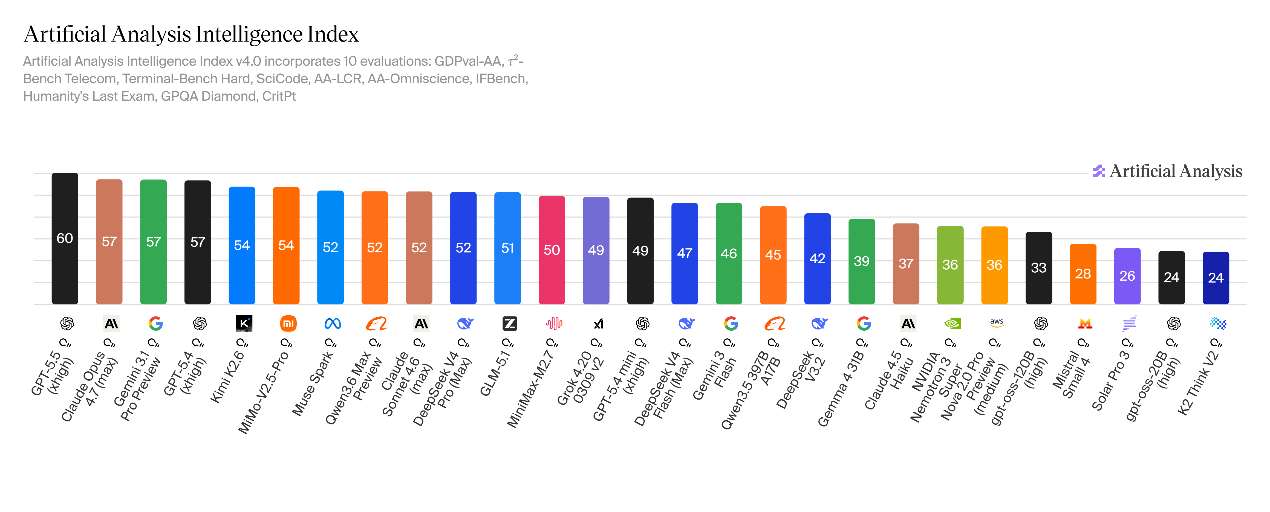

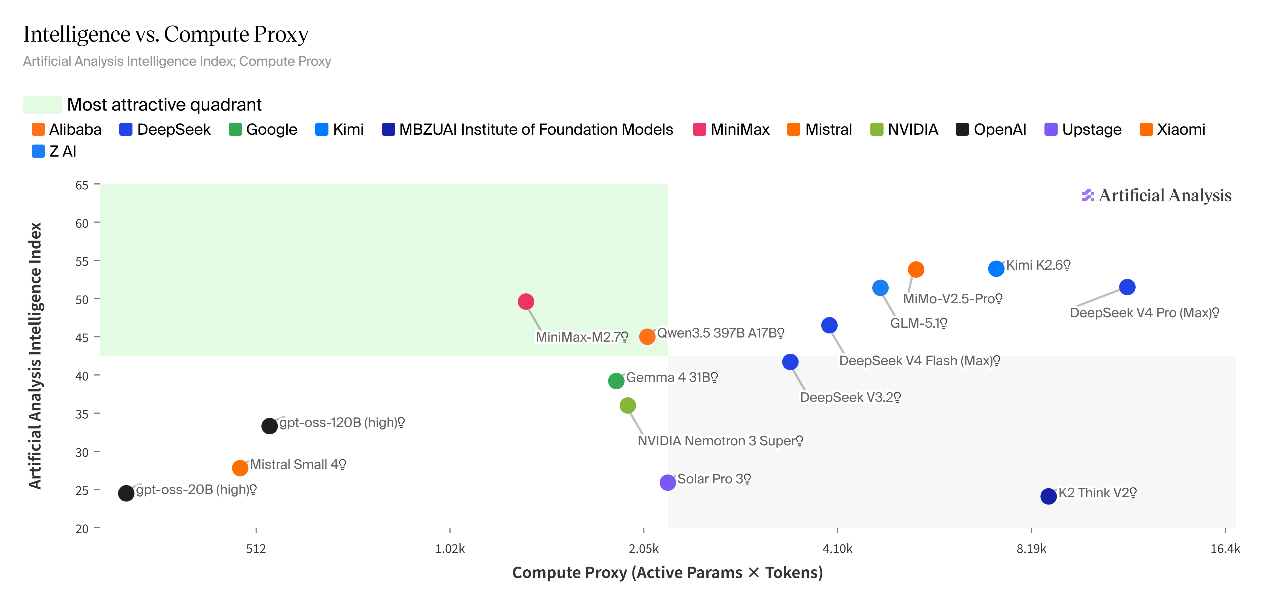

Artificial Analysis heeft een speciale evaluatie uitgevoerd van de redeneermogelijkheden van DeepSeek-V4. De resultaten laten zien dat V4-Pro 52 punten scoorde in de kunstmatige analyse-intelligentie-index, dat een sprong van 10 punten maakte vergeleken met de 42 punten van de V3.2-versie, en dat 's werelds tweede grootste open source-inferentiemodel werd, na Kimi K2.6.

V4-Flash scoorde 47 punten. De prestaties zijn zwakker dan die van V4-Pro, maar overtreffen aanzienlijk DeepSeek-V3.2. Het uitgebreide intelligentieniveau wordt vergeleken met Claude Sonnet 4.6 (volledige versie), dat zich tussen het topmodel met gesloten bron en het reguliere middenklassemodel bevindt.

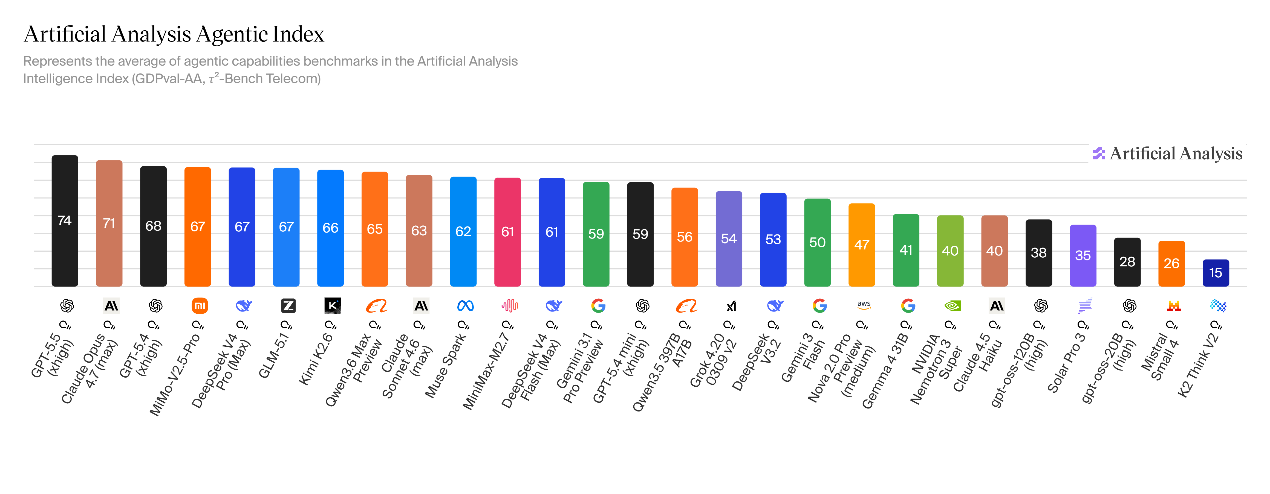

In termen van agenttaakprestaties levert V4-Pro de hoogste prestaties van alle open source-gewichtsmodellen in real-scene agenttaken. scoorde 1554 en overtrof Kimi K2.6 (1484), GLM-5.1 (1535), GLM-5 (1402) en MiniMax-M2.7 (1514).

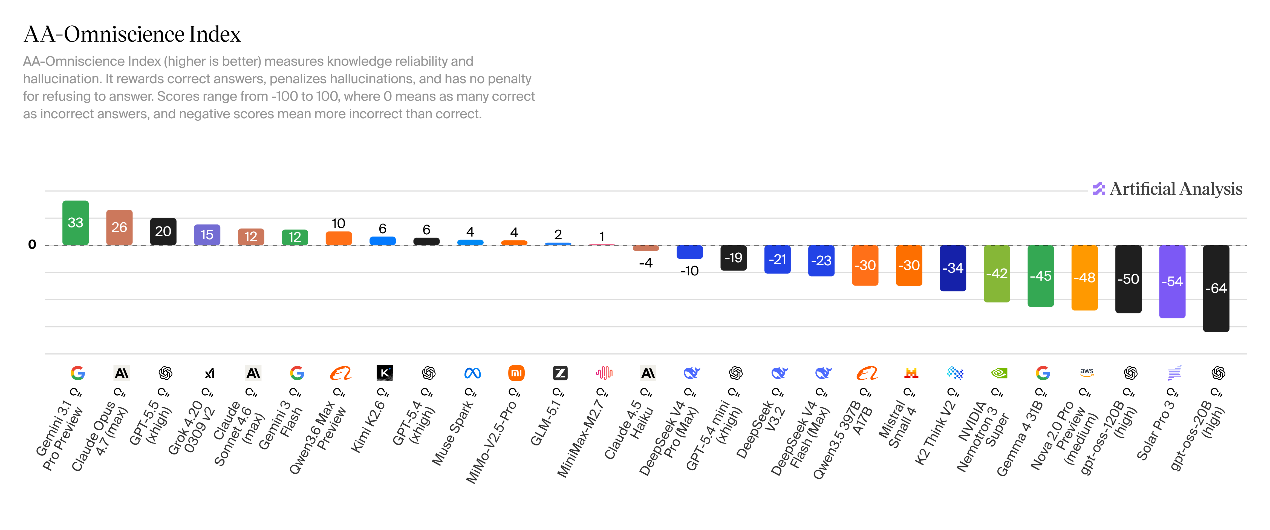

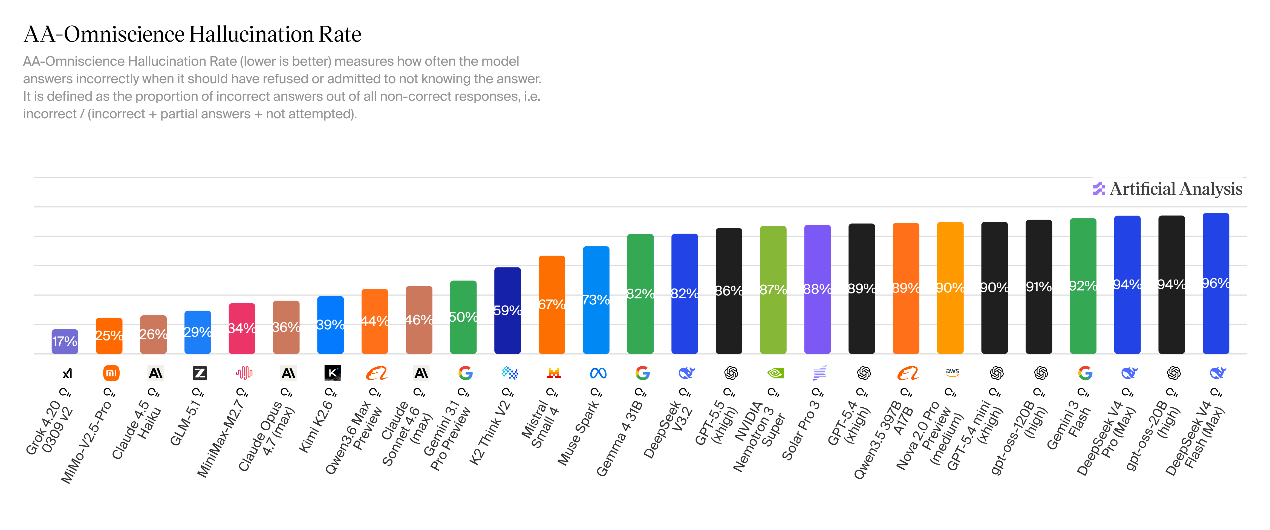

De kennisreserve van DeepSeek-V4 is geüpgraded, maar de incidentie van hallucinaties is toegenomen. V4-Pro scoorde -10 in de alwetende uitgebreide evaluatie-index (AA-Omniscience), 11 punten hoger dan de V3.2-redeneringsversie. De kern profiteerde van de aanzienlijke optimalisatie van de nauwkeurigheid van kennisantwoorden. V4-Flash scoorde -23 en het algehele niveau was in principe hetzelfde als V3.2.

Vergeleken met het hallucinatiepercentage van V3.2 (82%) is het hallucinatieprobleem van de twee V4-modellen prominent: Het hallucinatiepercentage van V4-Pro is 94% en het hallucinatiepercentage van V4-Flash is 96%, wat betekent dat het model bijna altijd met geweld antwoorden zal genereren in onbekende probleemscenario's.

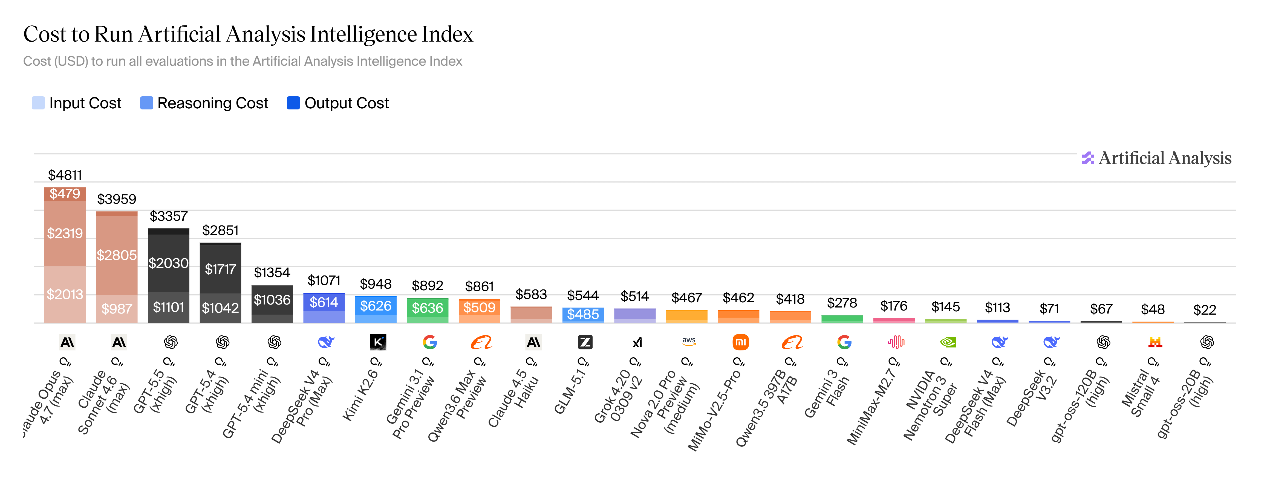

De gebruikskosten van DeepSeek-V4 zijn lager dan die van het beste closed-sourcemodel, hoger dan het reguliere open-sourcemodel, en zijn aanzienlijk gestegen vergeleken met de vorige generatie. Na voltooiing van een volledige reeks evaluaties van handmatige analyse-intelligentie-indexen bedragen de exploitatiekosten van V4-Pro US$1.071, wat slechts minder is dan een kwart van Claude Opus 4.7 (US$4.811); het is echter nog steeds hoog in vergelijking met vergelijkbare open source-modellen, hoger dan Kimi K2.6 (US$948), GLM-5.1 (US$544), DeepSeek-V3.2 (US$71) en gpt-oss-120B (US$67 USD). De bedrijfskosten van DeepSeek-V4-Flash bedragen slechts ongeveer 113 dollar, wat een aanzienlijk kostenvoordeel met zich meebrengt.

Na voltooiing van het standaardevaluatieproces bereikte het V4-Pro-uitvoertokenverbruik 190 miljoen, wat een van de modellen is met het hoogste tokenverbruik in deze evaluatie; Het verbruik van V4-Flash steeg verder naar 240 miljoen tokens. Zelfs als de prijs laag is, is het hoge tokenverbruik nog steeds de belangrijkste reden waarom de uitgebreide gebruikskosten van V4-Pro hoger zijn dan die van andere open source-modellen.

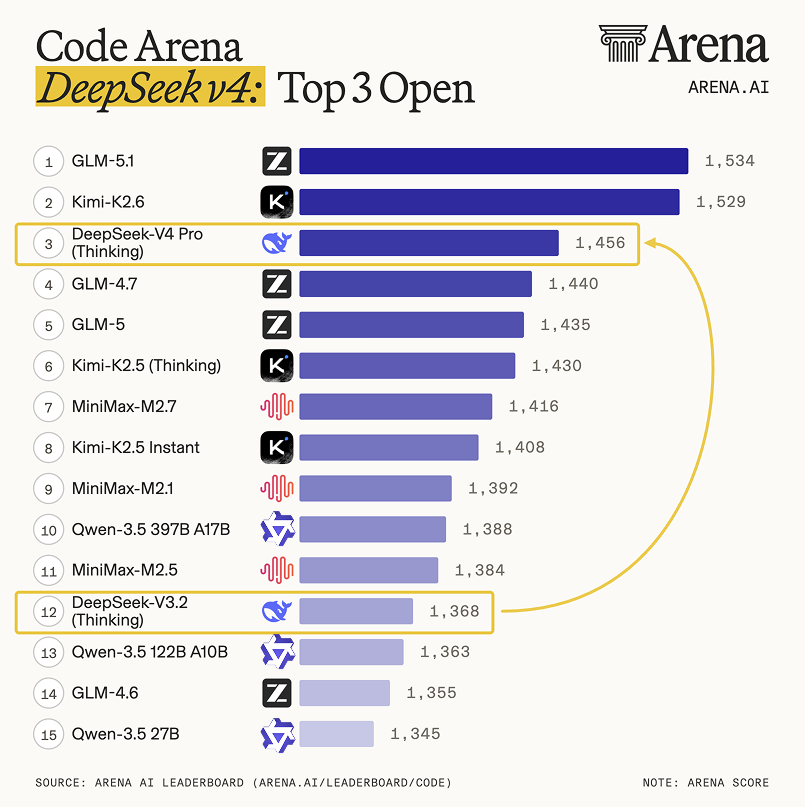

In andere recensies beschrijft Large Model Arena Arena.ai dat DeepSee k-V4-Pro wordt gekarakteriseerd als "een grote sprong vergeleken met DeepSeek-V3.2" , met een derde plaats onder de open source-modellen en een 14e plaats algemeen in zijn code-arena. DeepSeek-V4-Pro bevindt zich op hetzelfde niveau als GPT-5.4-high en Gemini-3.1-Pro wat betreft webontwikkelingstaken voor agenten. Op het gebied van tekst staat DeepSeek-V4-Pro op de tweede plaats onder de open source-modellen en op de veertiende plaats in het algemeen, hetzelfde als Kimi-2.6. DeepSeek-V4-Flash staat op de 10e plaats onder de open source-modellen en op de 14e plaats in het algemeen.

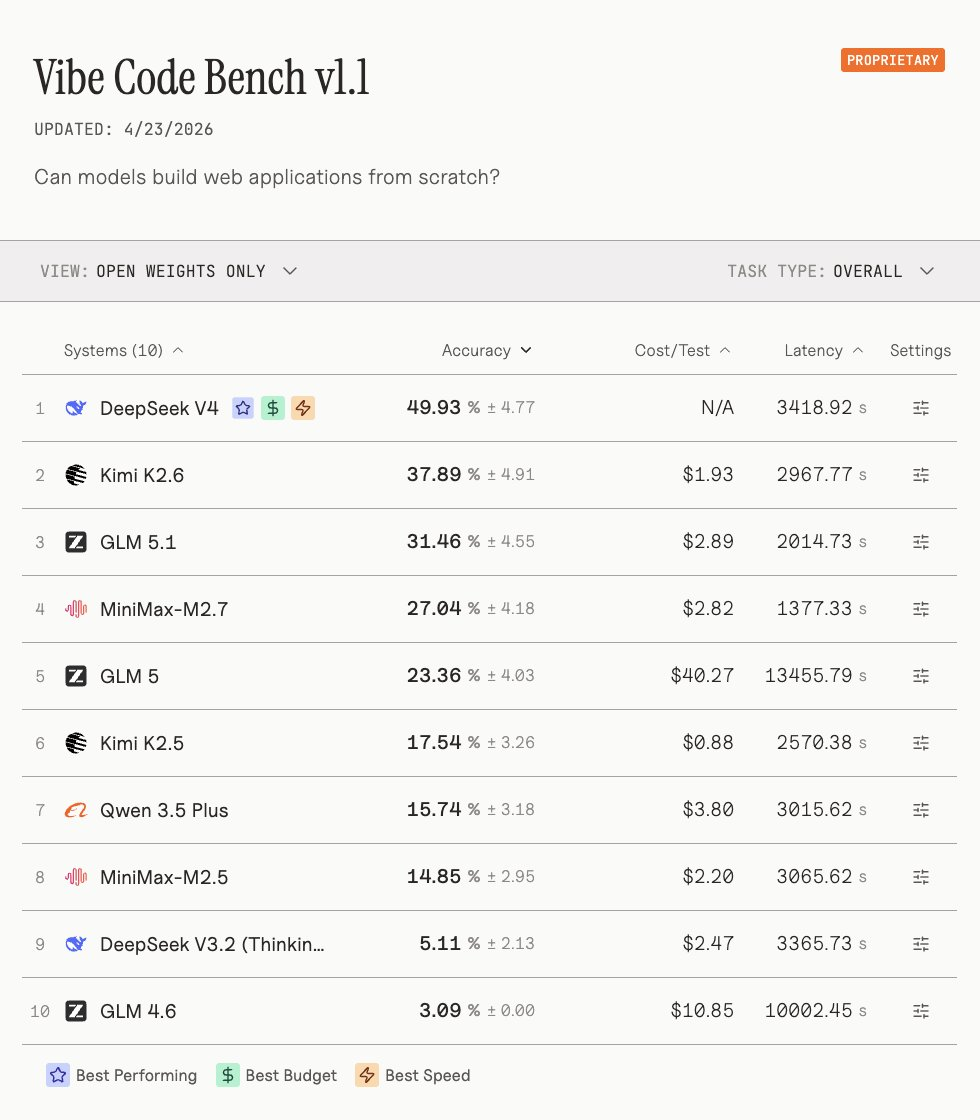

Vals AI, een andere evaluatiepartij, zei dat DeepSeek-V4 de eerste plaats won van het open source gewichtsmodel met een "overweldigend voordeel" in zijn Vibe Code Benchmark (sfeercodebenchmark). behaalde een prestatiesprong van ongeveer 10 keer vergeleken met de vorige generatie V3.2, en versloeg zelfs Gemini. Top closed source-modellen zoals 3.1 Pro. DeepSeek-V4 is ook het enige open source-gewichtsmodel dat 40% scoort op Vibe Code Benchmar.

Vergeleken met de mogelijkheden van DeepSeek-V4 besteden overzeese landen meer aandacht aan de samenwerking tussen DeepSeek en Huawei.

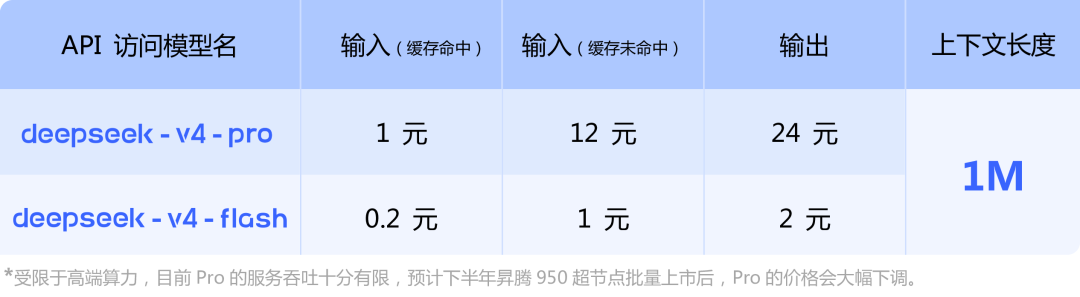

Onderaan de door DeepSeek-V4 aangekondigde API-prijsinformatie werd in de officiële mededeling vermeld: "Beperkt door high-end rekenkracht is de huidige servicedoorvoer van Pro zeer beperkt. Er wordt verwacht dat na de massale lancering van Ascend 950-supernodes in de tweede helft van het jaar de prijs van Pro aanzienlijk zal worden verlaagd."

DeepSeek verklaarde in het technische rapport dat V4 is gelanceerd op NVIDIA. De fijnmazige EP-oplossing (expert parallellisme) is geverifieerd op de GPU- en Huawei Ascend NPU-platforms. Vergeleken met de krachtige niet-fusiebasislijn kan het een versnellingseffect van 1,50 ~ 1,73 keer bereiken op algemene redeneringstaken, en een versnellingseffect van 1,96 keer in vertragingsgevoelige scenario's (zoals RL-aftrek en snelle proxyservices).

Na de release van V4 kondigde Huawei Ascend tegelijkertijd aan dat “het hele assortiment supernode-producten modellen uit de DeepSeek-V4-serie ondersteunt.” Er wordt gemeld dat Ascend 950 de aandachtsberekening en de geheugentoegangsoverhead vermindert door kernel- en multi-stream parallelle technologie te integreren, de inferentieprestaties aanzienlijk te verbeteren en meerdere kwantiseringsalgoritmen te combineren om een hoge doorvoer en lage latentie te bereiken. DeepSeek-V4-modelinferentie-implementatie.

Over de samenwerking van DeepSeek met Huawei zei He Hui, directeur halfgeleideronderzoek bij Omdia, een marktonderzoeksorganisatie: “Dit is van groot belang voor de Chinese kunstmatige intelligentie-industrie.”

Hij zei verder: "Huawei's Ascend-chip is China's zelfontwikkelde chip. Het hoogste product dat Nvidia kan vervangen. Het grote DeepSeek-V4-model is aangepast om te worden uitgerust met Huawei-chips, wat aangeeft dat China's grootste model nu gelokaliseerde hardware kan implementeren.

Goldman Sachs-analist Christopher. Moniz merkte op dat na de Bij de release van de DeepSeek-V4 preview-versie zijn de GPU- en binnenlandse chipsectoren versterkt. Een van de belangrijkste zorgen is de onderliggende chiparchitectuur die het V4-model ondersteunt: inclusief de chips die worden gebruikt voor modeltraining en de hardwareapparaten die worden gebruikt in de inferentiefase. Huawei's nieuwe generatie kunstmatige intelligentie-computercluster uitgerust met een Ascend AI-processor kan worden aangepast om het DeepSeek-V4-model uit te voeren DeepSeek's voortdurende versie van geavanceerde grote modellen

Deze verschuiving in de technologieroute van DeepSeek bevestigt ook de eerdere zorgen van Nvidia CEO Jen-Hsun Huang: Nvidia loopt het risico het Chinese ontwikkelaarsecosysteem te verliezen.

Eerder deze maand accepteerde NVIDIA-oprichter Huang Jensen Dwarkesh. In een exclusief interview zei Patel ooit: "Als DeepSeek eerst op het Huawei-platform wordt uitgebracht, zal dat catastrofaal zijn voor de Verenigde Staten." Volgens Huang Renxun is DeepSeek weliswaar een open source-model en kan het ook op NVIDIA-producten worden gebruikt, maar als DeepSeek specifiek is geoptimaliseerd voor de rekenkracht van Huawei, zal NVIDIA in het nadeel zijn vanwege beperkingen zoals beperkingen op de aankoop van geavanceerde rekenkracht.

In tegenstelling tot DeepSeek-R1 veroorzaakte DeepSeek-V4 geen scherpe daling van de Amerikaanse technologieaandelen. Senior aandelenanalist Ivan Su van Morningstar zei dat het voor DeepSeek-V4 moeilijk is om de oorspronkelijke marktinvloed van het inferentiemodel R1 te repliceren, omdat de handelsmarkt de verwachtingen al volledig heeft verwerkt: de Chinese kunstmatige intelligentietechnologie is concurrerend en heeft lagere gebruikskosten.

Ivan Su zei ook dat de nieuwe productpositionering van DeepSeek andere grote binnenlandse open source-modellen direct in de gelederen van concurrerende producten heeft ingedeeld.

Brookings Institution-onderzoeker Kyle Chan zei dat DeepSeek-V4 indrukwekkend is omdat het een bijna state-of-the-art model is met een efficiënte contextlengte van 1 miljoen token en kan draaien op de nieuwe chips van Huawei. DeepSeek-V4 repliceerde het ‘DeepSeek-R1-moment’ niet omdat de verwachtingen van de buitenwereld voor de Chinese AI-capaciteiten veel hoger zijn dan voorheen.