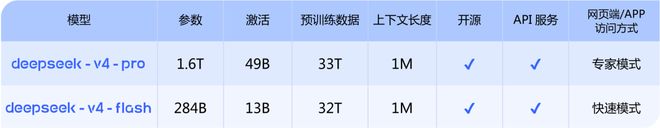

De langverwachte DeepSeek V4 is eindelijk uitgebracht! Zojuist is de langverwachte previewversie van DeepSeek V4 officieel gelanceerd. Twee versies - V4-Pro en V4-Flash, de hele serie wordt standaard geleverd met 1M (miljoen woorden) ultralange context, gesynchroniseerde open source-modelgewichten en technische rapporten .

In de twee dagen vóór 1 mei zijn grote modellen aan een nieuwe golf van releases begonnen.

Op 23 april om 12.00 uur overhandigde "Genius Boy" Yao Shunyu zijn eerste modelantwoordblad nadat hij bij Tencent kwam. Tencent Hunyuan Hy3 preview-versie werd onthuld. Het heeft een MoE-architectuur met 295 miljard parameters, geactiveerde parameters 21B, de inferentie-efficiëntie is met 40% verhoogd en de inputprijs is verlaagd tot 1,2 yuan/miljoen tokens.

Vanochtend vroeg lanceerde OpenAI GPT-5.5 voor betalende gebruikers en kondigde officieel het API-plan aan, dat zich richt op de Agent-workflow en het voltooien van taken in meerdere stappen. Het contextvenster is uitgebreid naar 1 miljoen tokens, en de API-prijzen zijn ook verhoogd: voer $ 5 in, voer $ 30/miljoen tokens uit.

Oppervlakkig gezien hebben de drie bedrijven verschillende paden: OpenAI kiest de high-end closed-source route en blijft het prijsplafond verhogen; Tencent sluit het model aan op zijn eigen ecosysteem en gebruikt kosteneffectiviteit om grootschalige commercialisering te stimuleren; DeepSeek zet de open source-traditie voort en duwt tegelijkertijd de contextlengte naar een nieuw inclusief kritisch punt.

Tegelijkertijd Agent-mogelijkheden, ultralange context, code en toolaanroepen, deze drie trefwoorden,Het komt herhaaldelijk voor in de nieuwe modellen die door de drie bedrijven zijn uitgebracht. Ze richten zich allemaal op dezelfde richting: het model in staat stellen langere informatie te verwerken, autonoom te opereren in complexere taakketens en echt ingebed te zijn in de workflow 「」.

01

DeepSeek V4's "Pragmatisme"

DeepSeek Deze release heeft de context van Million Words veranderd van "high-end optioneel" naar "basis standaard".

Voordien waren contextlengtes op 1M-niveau gebruikelijker in geavanceerde versies van vlaggenschip-closed-sourcemodellen. De hoge belkosten waren voldoende om de meeste ontwikkelaars en kleine en middelgrote ondernemingen te verbieden.

De aanpak van DeepSeek is heel duidelijk: zowel de V4-Pro- als de V4-Flash-versie zijn standaard uitgerust met een contextlengte van 1M. De eerste verankert de ultieme prestaties, terwijl de laatste een inclusieve economische optie biedt, die gebruikers met verschillende behoeften volledig dekt. Deze strategie van “willekeurige decentralisatie van kerncapaciteiten” verlaagt in wezen de drempel voor de overname van lange tekstverwerkingsmogelijkheden door de industrie.

Bron afbeelding: officiële DeepSeek-website

De Flash-versie richt zich op extreem lage latentie en hoge kosten en is de kernoplossing van DeepSeek voor lichtgewicht hoogfrequente scenario's . Met 13B-activeringsparameters, een nieuw aandachtsmechanisme voor tokencompressie en optimalisatie van de DSA-sparse aandachtsarchitectuur, bereikt het een extreem hoge responssnelheid en blijft het dicht bij de kernredeneermogelijkheden van de Pro-versie. Voor realtime dialooginteracties, pijplijnen voor functieaanroepen en zelfs alle lichtgewichtscenario's die gevoelig zijn voor reactiesnelheid, kan deze functie een aanzienlijke verbetering van de ervaring opleveren.

Wat belangrijker is, is de concurrerende kostenstructuur .

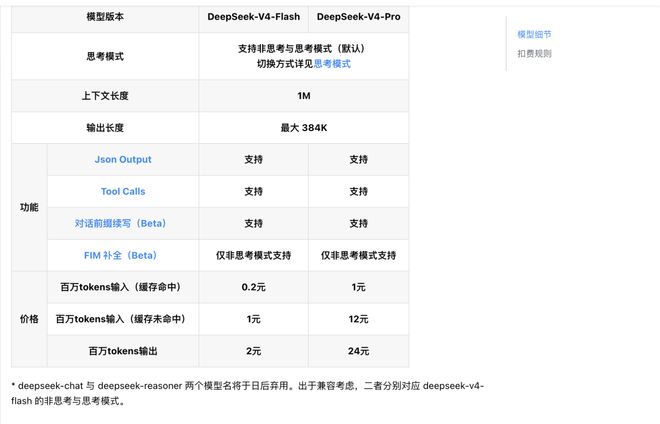

Volgens het officiële API-prijsdocument van DeepSeek gebruikt de Flash-versie een gelaagde factureringsregel: het invoertoken voor een cachehit is zo laag als 0,2 yuan/miljoen tokens, het invoertoken voor een cachemisser is 1 yuan/miljoen tokens, en het uitvoertoken kost 2 yuan/miljoen tokens.

Er zijn verschillende versies van DeepSeek V4 | Afbeeldingsbron: DeepSeek API-document

Dergelijke gebruiksvriendelijke prijzen, gecombineerd met de 1M contextuele mogelijkheden die standaard bij de hele serie worden geleverd, zorgen ervoor dat 'kosten per gesprek' niet langer een kernbeperking zijn in technisch ontwerp - ontwikkelaars kunnen prioriteit geven aan productervaring en architectonisch ontwerp zonder herhaaldelijk afwegingen te maken tussen het aantal gesprekken en de kosten.

Flash lost de universele vraag van "betaalbaar en snel" op, terwijl V4-Pro een andere kernvraag beantwoordt: hoe ver kunnen de grenzen van de mogelijkheden van open source grote modellen worden verlegd.

De meest intuïtieve verbetering van vaardigheden draait nog steeds om lange context. DeepSeek vergroot direct de lengte van de modelcontext van 128K in de vorige generatie V3.2 naar 1M (één miljoen tokens). In combinatie met de innovatie van de onderliggende architectuur vermindert het de vereisten voor lange contextberekeningen en videogeheugen aanzienlijk, terwijl de prestaties van het volledige contextvenster intact blijven.

Op deze schaal kunnen ontwikkelaars rechtstreeks complete codebases, ultralange industriële documenten, projectbestanden met meerdere rondes en zelfs complete boeken met miljoenen woorden importeren voor end-to-end verwerking, zonder de noodzaak om extra complexe RAG-systemen (Retrieval Augmentation Generation) te bouwen, wat de technische koppeling van lange tekstverwerking aanzienlijk vereenvoudigt.

Wat de onderliggende architectuur betreft, gebruikt de Pro-versie een MoE-architectuur met een totale parameter van 1,6T en een activeringsparameter van 49B. De hoeveelheid pre-trainingsgegevens bereikt 33T, wat een uitgebreide verdieping is van de DeepSeek hybride expertroute. Uit officiële evaluatiegegevens blijkt dat het bij evaluaties van kernredeneringen, zoals wiskunde, STEM en code op concurrentieniveau, alle momenteel publiekelijk geëvalueerde open source-modellen heeft overtroffen en een niveau heeft bereikt dat vergelijkbaar is met 's werelds beste closed source-modellen.

Wat betreft Agent-mogelijkheden ligt de leveringskwaliteit dicht bij de niet-denkmodus van Claude Opus 4.6 is de interne gebruiksfeedback beter dan Anthropic Sonnet 4.5, en is het de belangrijkste Agentic Coding-tool geworden voor de interne medewerkers van DeepSeek.

Op functioneel niveau ondersteunen beide versies van de V4-serie zowel de niet-denkmodus als de denkmodus. Ontwikkelaars kunnen de denkintensiteit aanpassen via de parameter redenering_effort. Tegelijkertijd ondersteunen ze volledig de mogelijkheden voor Json Output, Tool Calls en de voortzetting van gesprekken.

Qua prijs vervolgt de Pro-versie ook de kosteneffectieve route . De officiële prijs is: input token 1 yuan/miljoen tokens voor cachehits, input token 12 yuan/miljoen tokens voor cache missers, en output token prijzen 24 yuan/miljoen tokens, wat aanzienlijk lager is dan de buitenlandse vlaggenschip closed-source modellen van hetzelfde niveau.

API-toegang heeft ook een extreem lage drempel bereikt. Ontwikkelaars hoeven de originele base_url niet te wijzigen. Ze hoeven alleen de modelparameter te vervangen door de overeenkomstige versienaam om de toegang te voltooien. Het is ook compatibel met OpenAI ChatCompletions en Anthropic-interfaceformaten.

Deze combinatie van "verhoogde mogelijkheden + lagere kosten" zorgt ervoor dat eersteklas capaciteiten voor grote modellen niet langer de exclusieve hulpbron van een paar fabrikanten zijn. Terwijl de industrie geleidelijk in een vicieuze cirkel van parameterwapenwedloop terechtkomt, biedt DeepSeek een nieuw model voor de universalisering van grote modellen met de standaardconfiguratie van miljoenen contexten en full-link open source-opties.

Tegelijkertijd heeft DeepSeek V4 speciale aanpassingen en optimalisaties doorgevoerd voor reguliere Agent-producten zoals Claude Code, OpenClaw, OpenCode en CodeBuddy, en zijn de prestaties verbeterd in daadwerkelijke scenario's zoals codeertaken en het genereren van documenten. De waarde van het model moet uiteindelijk worden getest in echte ontwikkelings- en werkprocessen.

02

blijft open source en de API is volledig open.

DeepSeek vervolgt de open source-route en opent direct alle API-aanroepen.

Momenteel zijn de modelgewichten van DeepSeek-V4 gelijktijdig geopend voor download op de Hugging Face- en ModelScope-platforms, en zijn de ondersteunende technische rapporten ook openbaar gemaakt, ter ondersteuning van ontwikkelaars voor lokale implementatie en secundaire ontwikkeling.

Anders dan de industriële praktijk van "open source gecastreerde versie, gesloten source volledige versie" door sommige fabrikanten, behouden de twee open source-versies volledig alle mogelijkheden die consistent zijn met de officiële cloud-API - inclusief niet-denkende / denkende dubbele modus, 1 miljoen ultralange contextverliesloze verwerking, speciale Agent-optimalisatie en volledige mogelijkheden voor het aanroepen van tools, zonder enige functionele castratie.

Dit betekent dat u, of u nu een kleine of middelgrote startup, een individuele ontwikkelaar of een wetenschappelijke onderzoeksinstelling bent, een grote modellenbasis kunt verkrijgen met miljoenen contexten, redeneringen op het hoogste niveau en agentcapaciteiten zonder drempelwaarde. U hoeft niet langer hoge closed-source interfacekosten te betalen voor geavanceerde modelmogelijkheden.

Om de implementatiedrempel verder te verlagen, heeft DeepSeek tegelijkertijd de volledige procestoolketen voor het verfijnen, kwantificeren en inferentieversnelling van modellen open source gemaakt, en de native aanpassing op dag 0 van mainstream inferentieframeworks zoals vLLM en TGI, en mainstream Agent-frameworks zoals LangChain en LlamaIndex voltooid. Het heeft ook een full-stack implementatieoplossing voor binnenlandse computerplatforms geopend, waardoor ontwikkelaars snel applicaties in verschillende hardwareomgevingen kunnen implementeren.

Tegelijkertijd heeft DeepSeek ook een duidelijk transitieplan voor modeliteratie gegeven: de oude API-interfacemodelnamen deepseek-chat en deepseek-reasoner zullen over drie maanden (24 juli 2026) niet meer worden gebruikt. In het huidige stadium verwijzen deze twee modelnamen respectievelijk naar de niet-denkende modus en de denkende modus van deepseek-v4-flash, waardoor er voldoende tijd overblijft voor ontwikkelaars om soepel te migreren.

03

Vastbesloten om van AI een 'infrastructuurmodel' te maken.

Kijkend naar de releases van de afgelopen twee dagen is één trend duidelijk: elk bedrijf versnelt de Agent-mogelijkheden.

De afgelopen twee jaar heeft de aandacht van het publiek en de kapitaalmarkt voor grote modellen zich grotendeels geconcentreerd op 'slimheid', maar nu is de aandacht verschoven naar 'wie dingen stabieler gedaan kan krijgen'. De focus van de release van GPT-5.5 ligt niet op de mate waarin het multimodale begrip is verbeterd, maar op de mogelijkheden voor continue uitvoering in scenario's zoals Agent-programmering, computergebruik en kenniswerk. Het belangrijkste verkoopargument van Tencent Hunyuan Hy3 is ook het ‘vermogen om te handelen’ in de echte wereld. DeepSeek V4 richt zich rechtstreeks op Agent-mogelijkheden en lange contextverwerking, met een duidelijk doel van daadwerkelijke werklasten.

Achter deze verandering schuilt het feit dat de hele industrie op weg is naar concurrentie op het gebied van "modelutiliteit". Tegenwoordig maken gebruikers en zakelijke klanten zich steeds minder zorgen over de plaats van uw model in een bepaalde evaluatie. Waar het hen om gaat is hoeveel werk het model en het product hen kunnen helpen: of dit model mij kan helpen code te schrijven, of het complexe documenten aankan, of het taken uit meerdere stappen zonder fouten kan uitvoeren, en of het tegen redelijke kosten kan draaien.

Bron afbeelding: DeepSeek officiële website

Aan het einde van het vandaag gepubliceerde artikel citeert DeepSeek een zin van "Xunzi": " Laat je niet verleiden door lof, wees niet bang voor laster, volg het pad en wees oprecht ", vervolg om zijn eigen technische route te verankeren. In de huidige context van grote concurrentie tussen modellen is de betekenis van deze zin heel duidelijk: laat je niet storen door externe evaluaties en lawaai, en concentreer je op het goed doen van de dingen.

De acties van DeepSeek van het afgelopen jaar hebben inderdaad deze logica geïmplementeerd: open source en openheid gebruiken om de ecologische invloed van mondiale ontwikkelaars te vestigen, ultieme kosteneffectiviteit gebruiken om de barrières voor het gebruik van hoogwaardige AI-mogelijkheden te doorbreken, en solide onderliggende architectuurinnovatie gebruiken om de meest reële pijnpunten van ontwikkelaars en zakelijke gebruikers op te lossen.

Vanaf de opkomst van het R1-inferentiemodel tot V4 die voor het eerst lange contextmogelijkheden naar het inclusieve bereik duwde, heeft DeepSeek iets moeilijkers gedaan op een relatief "langzame" manier: Verander de mogelijkheden van topmodellen van een tool voor een paar mensen in een infrastructuur die meer mensen direct kunnen noemen.