Op 24 april werd de previewversie van DeepSeek's nieuwe seriemodel DeepSeek-V4 officieel gelanceerd en tegelijkertijd open source. Volgens rapporten heeft DeepSeek-V4 een ultralange context van een miljoen woorden en leidt het de binnenlandse en open source-velden op het gebied van agentcapaciteiten, wereldkennis en redeneerprestaties.

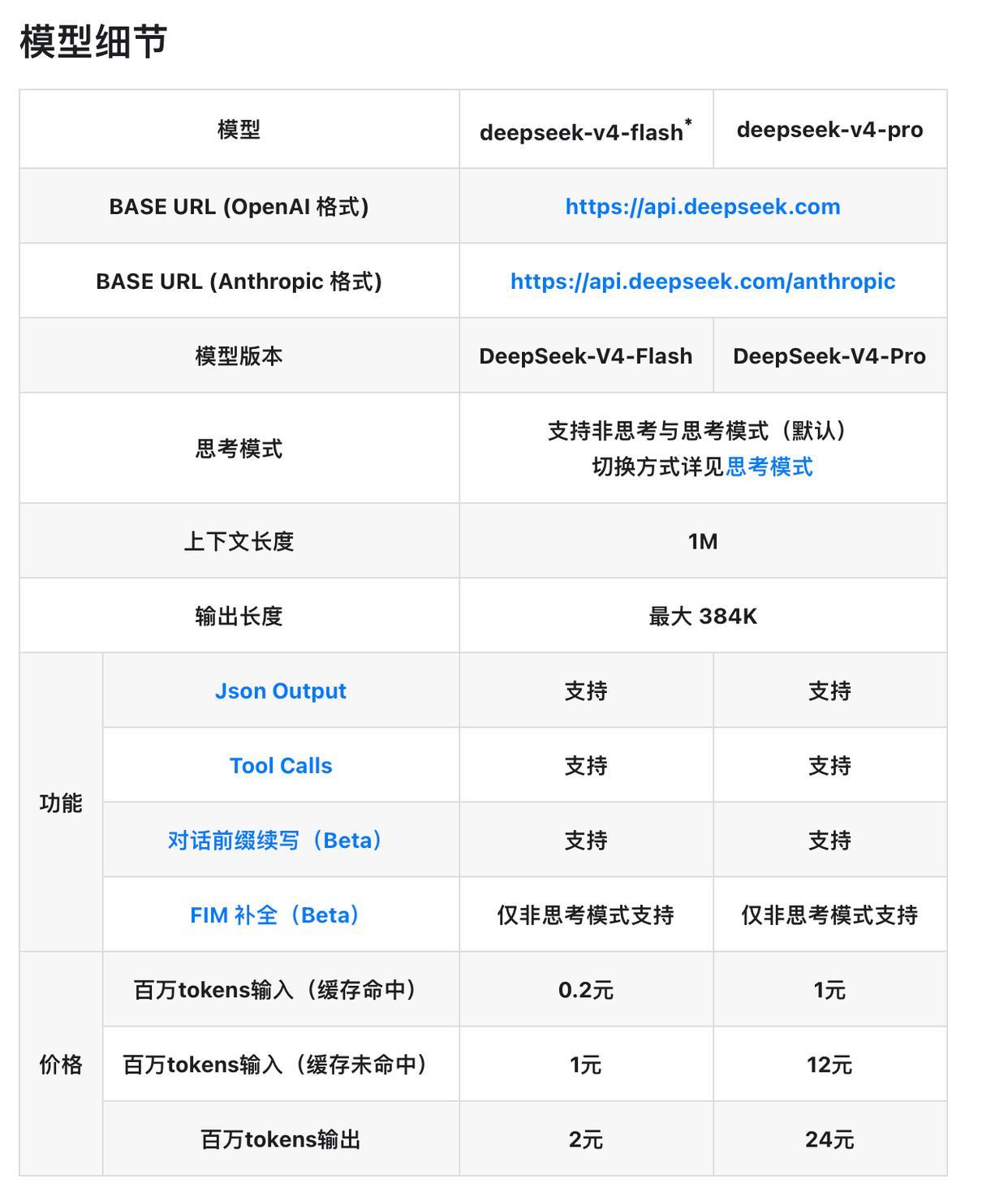

Log vanaf nu in op de officiële website chat.deepseek.com of de officiële app om met de nieuwste DeepSeek-V4 te praten en de nieuwe ervaring van 1M ultralang contextgeheugen te verkennen. De API-service is synchroon bijgewerkt en kan worden aangeroepen door de modelnaam te wijzigen in deepseek-v4-pro of deepseek-v4-flash.

Daarnaast heeft DeepSeek-V4 reguliere Agent-producten zoals Claude Code, OpenClaw, OpenCode en CodeBuddy aangepast en geoptimaliseerd, waardoor de prestaties bij taken zoals het genereren van code en documenten zijn verbeterd. Zowel V4-Pro als V4-Flash ondersteunen een contextlengte van 1M en bieden zowel de niet-denkmodus als de denkmodus. Deze laatste kan de parameter argumenting_effort instellen (high / max). Voor complexe Agent-scenario's is de officiële aanbeveling om de denkmodus te gebruiken en de intensiteit op maximaal in te stellen.