GPT Image2 vernieuwt het hele netwerk, maar waarom is het effect zo goed? Onderzoeksleider Chen Boyuan onthulde: De onderliggende architectuur is volledig gereconstrueerd. Maar hij weigerde te antwoorden of hij een diffusiemodel of autoregressieve technologie gebruikte, en beschreef het op mysterieuze wijze als een 'universeel model' of 'GPT op beeldgebied'.

Uit een tweet van Chen Boyuan bleek ook dat het slechts vier maanden duurde om zo’n grote verbetering te bereiken ten opzichte van GPT Image 1.5 eind december vorig jaar.

Voor zo’n baanbrekende prestatie bestaat het kernteam uit slechts 13 mensen.

Gabriel Goh, de leider van het hele team, plaatste een familiefoto van de AI-teamleden.

Sommige internetgebruikers in het commentaarveld klaagden: waarom zijn ze allemaal Aziatisch?

Chen Boyuan: Van het niet kennen van Python tot onderzoeksleider

Wat is precies de architectuur van GPT Image 2?

OpenAI wordt misschien nog lang niet aangekondigd, maar er zijn wel enkele sporen te zien uit de academische ervaring van kernteamleden.

Chen Boyuan is de onderzoeksleider van het team. Hij en een ander lid van Kiwhan Song hadden dezelfde mentor Vincent Sitzmann toen ze studeerden voor hun Ph.D. bij MIT.

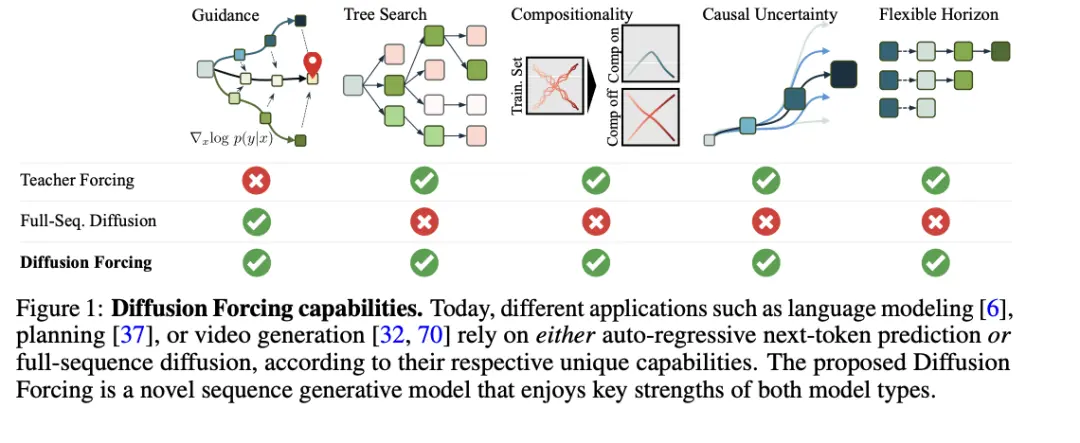

Zijn meesterwerk Diffusion Forcing: Next-token Prediction Meets Full-Sequence Diffusion tijdens zijn PhD werd geselecteerd voor NeurIPS 2024.

Deze studie stelt Diffusion Forcing voor, een nieuw trainingsparadigma voor het genereren van sequenties dat token-voor-token onafhankelijke diffusie van geluidsniveaus combineert met causale next-token-voorspelling, waarbij de generatie van variabele lengte van het autoregressieve model en de langeafstandsgeleidingsvoordelen van het volledige sequentiediffusiemodel worden geïntegreerd.

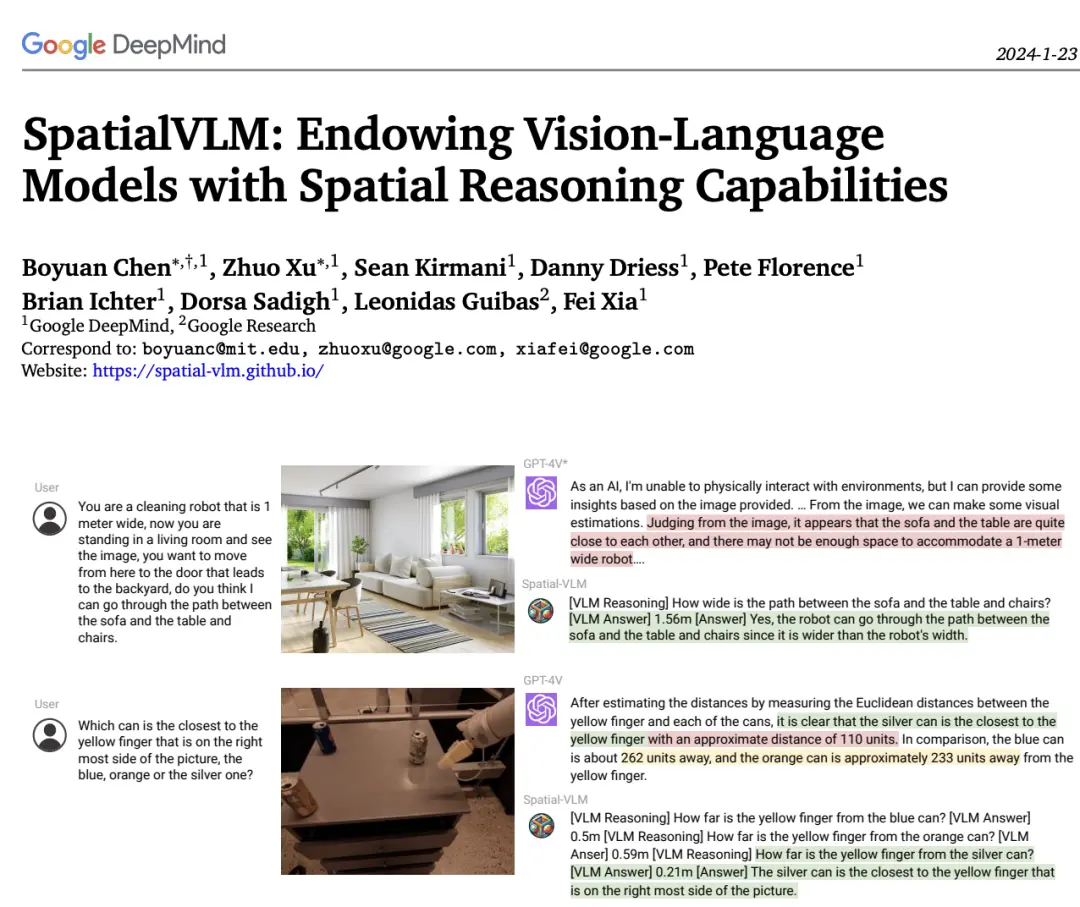

Tijdens zijn stage bij Google publiceerde hij als co-auteur ook SpatialVLM.

Door automatisch een 3D-ruimtelijk redenerende VQA-dataset op internetschaal te construeren (10 miljoen afbeeldingen, 2 miljard QA-paren), wordt het beeldtaalmodel voorzien van kwantitatieve/kwalitatieve ruimtelijke redeneringsmogelijkheden, en kunnen nauwkeurige waarden zoals metrische afstand, grootte en oriëntatie worden uitgevoerd vanuit een enkel 2D-beeld.

Dit onderzoek past denkketen-ruimtelijk redeneren toe op het gebied van belichaamde intelligentie.

Tijdens zijn stage bij Google werd de door hem ontwikkelde instructieverfijningstechnologie later overgenomen door Gemini 2.0.

Toen hij op de middelbare school deelnam aan een zomerkamp voor wetenschappelijk onderzoek, begreep hij de basissyntaxis van Python niet. Xia Fei, een senior onderzoeker bij Google DeepMind die hij destijds ontmoette, liet hem kennismaken met de wereld van AI.

Xia Fei nodigde hem twee keer uit om hoogwaardige stages te lopen bij DeepMind. Deze ervaringen stelden Chen Boyuan in staat technische ervaring op te doen in grootschalige modeltraining, en boden hem ook een waardevol perspectief voor het begrijpen van de datavereisten van multimodale systemen.

Na zijn afstuderen met een doctoraat, trad Chen Boyuan in juni 2025 in dienst bij OpenAI en werd al snel een van de vijf kernleden van GPT-beeldgeneratie. Hij was verantwoordelijk voor alle trainingen van het GPT-beeldgeneratiemodel en was ook lid van het Sora-videogeneratieteam.

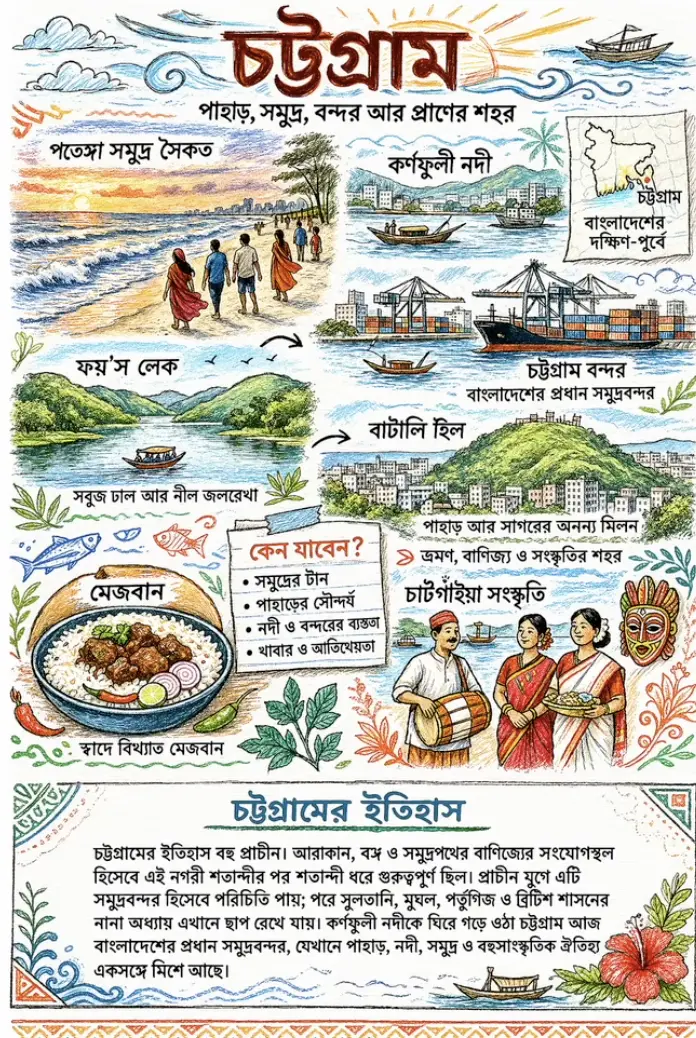

Tijdens de demonstratie maakte hij een poster voor zijn geboorteplaats Wuxi. Vervolgens maakte ik Koreaanse posters voor mijn teamgenoten uit Seoul en Bengaalse posters voor mijn teamgenoten uit Bangladesh. De weergave van de tekst in elk ervan is nauwkeurig.

Jianfeng Wang, Universiteit voor Wetenschap en Technologie van China: Laat Shengtu AI de wereldkennis begrijpen

Jianfeng Wang, die afstudeerde met een Ph.D. van de Universiteit voor Wetenschap en Technologie van China, is verantwoordelijk voor nog een verbazingwekkende vaardigheid in het GPT Image 2-team: instructies volgen en de wereld begrijpen.

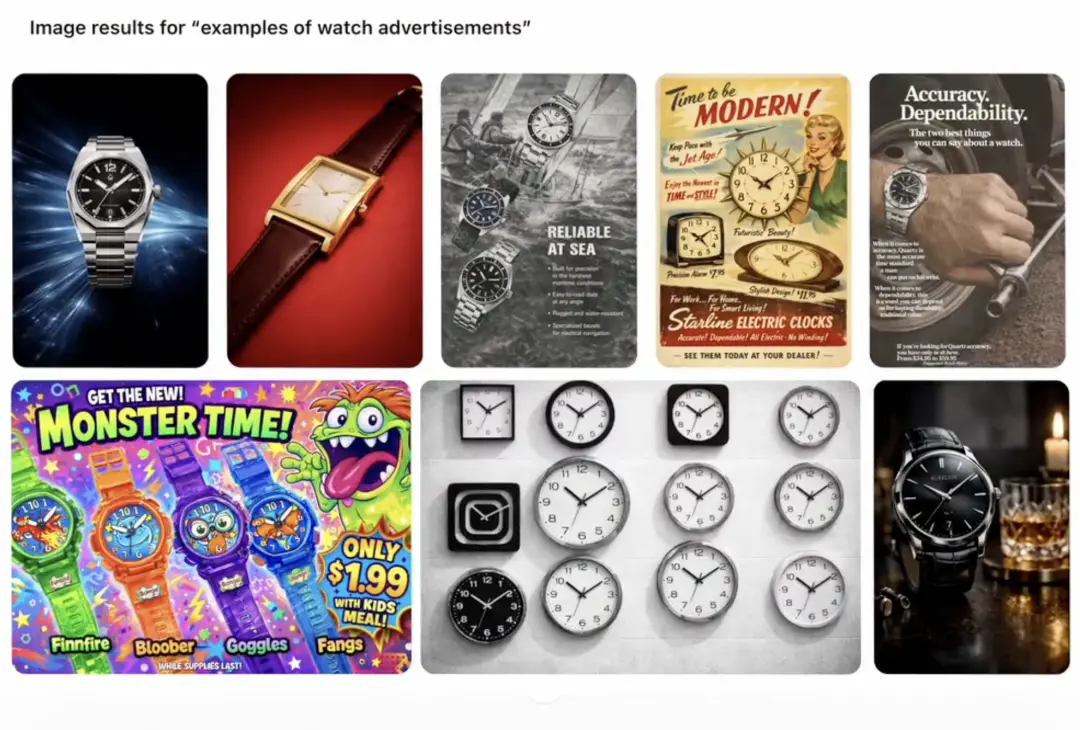

De eeuwige klok getekend door het oude model wijst altijd naar 10:10, wat is afgeleid van klokreclamefoto's op internet, die bijna allemaal 10:10 zijn.

Dit komt omdat horlogefabrikanten experimenten hebben uitgevoerd met psychologen en geloven dat dit de bereidheid van consumenten om horloges te kopen zal helpen stimuleren.

Hij vroeg het nieuwe model om 2:25, 3:30, 9:10 en 7:45 nauwkeurig te tekenen.

Dit is slechts een voorgerecht.

Complexere ruimtelijke indeling met appel in het midden, beker aan de rechterkant, boek bovenaan, camera aan de linkerkant en basketbal onderaan. De modellen zijn allemaal nauwkeurig uitgevoerd.

Voordat hij bij OpenAI kwam, werkte hij bijna negen jaar bij Microsoft. Toen ik bij Microsoft werkte, werkte ik samen met het OpenAI-team aan DALLE-3.

Hij heeft veel academische artikelen gepubliceerd op het gebied van computer vision, en zijn onderzoeksinhoud kan betrekking hebben op beeldclassificatie, doeldetectie, semantische segmentatie en het leren van visuele representaties.

Het vermogen om wereldkennis te begrijpen is enorm verbeterd en de semantische inhoud en functionele structuur van objecten zijn correct begrepen.

JianFeng Wang zei aan het einde van de demonstratievideo: GPT Image 2 elimineert de kloof tussen uw intentie en modeluitvoer.

Doe echt wat je wilt, en het model geeft je wat je wilt.

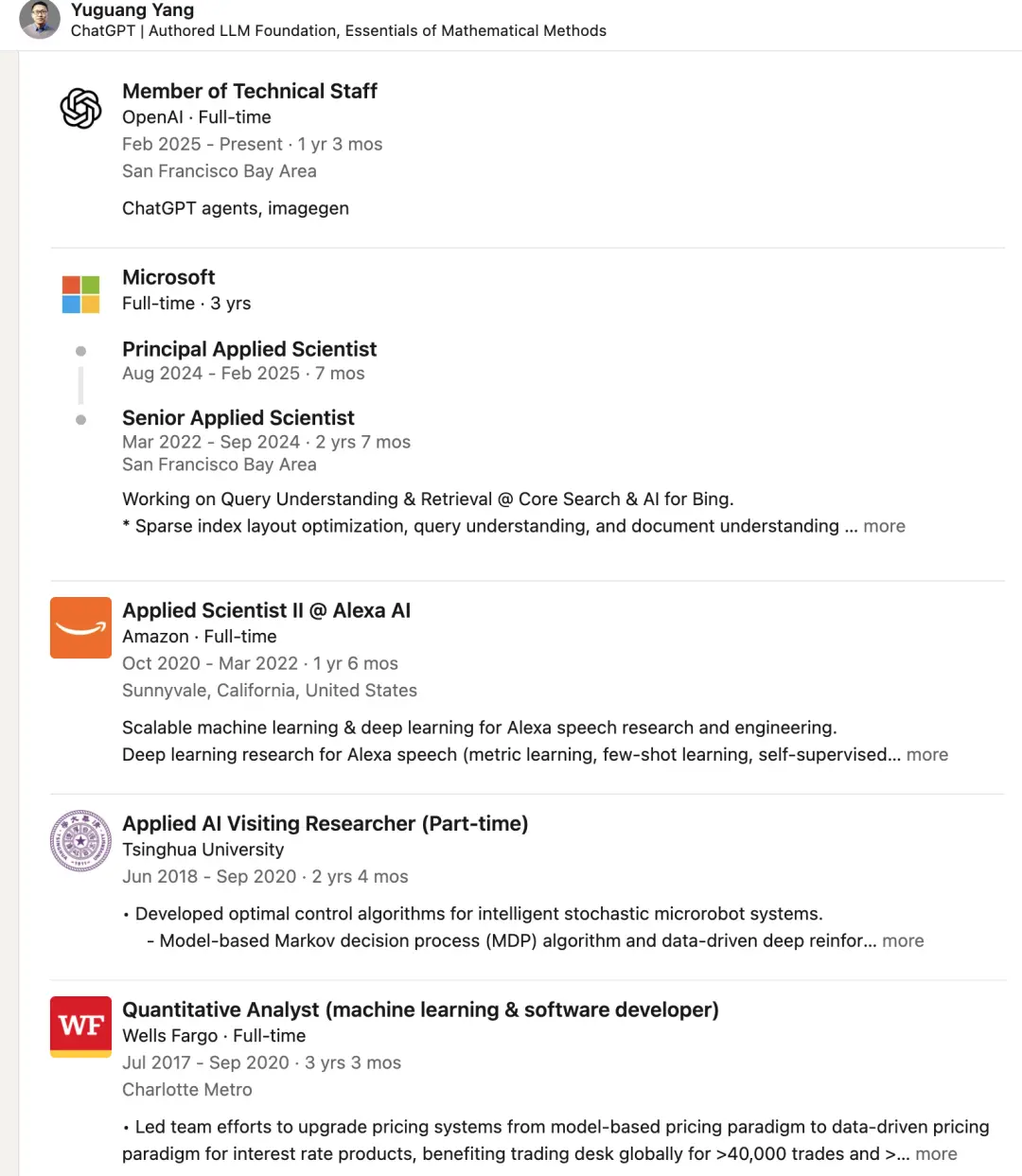

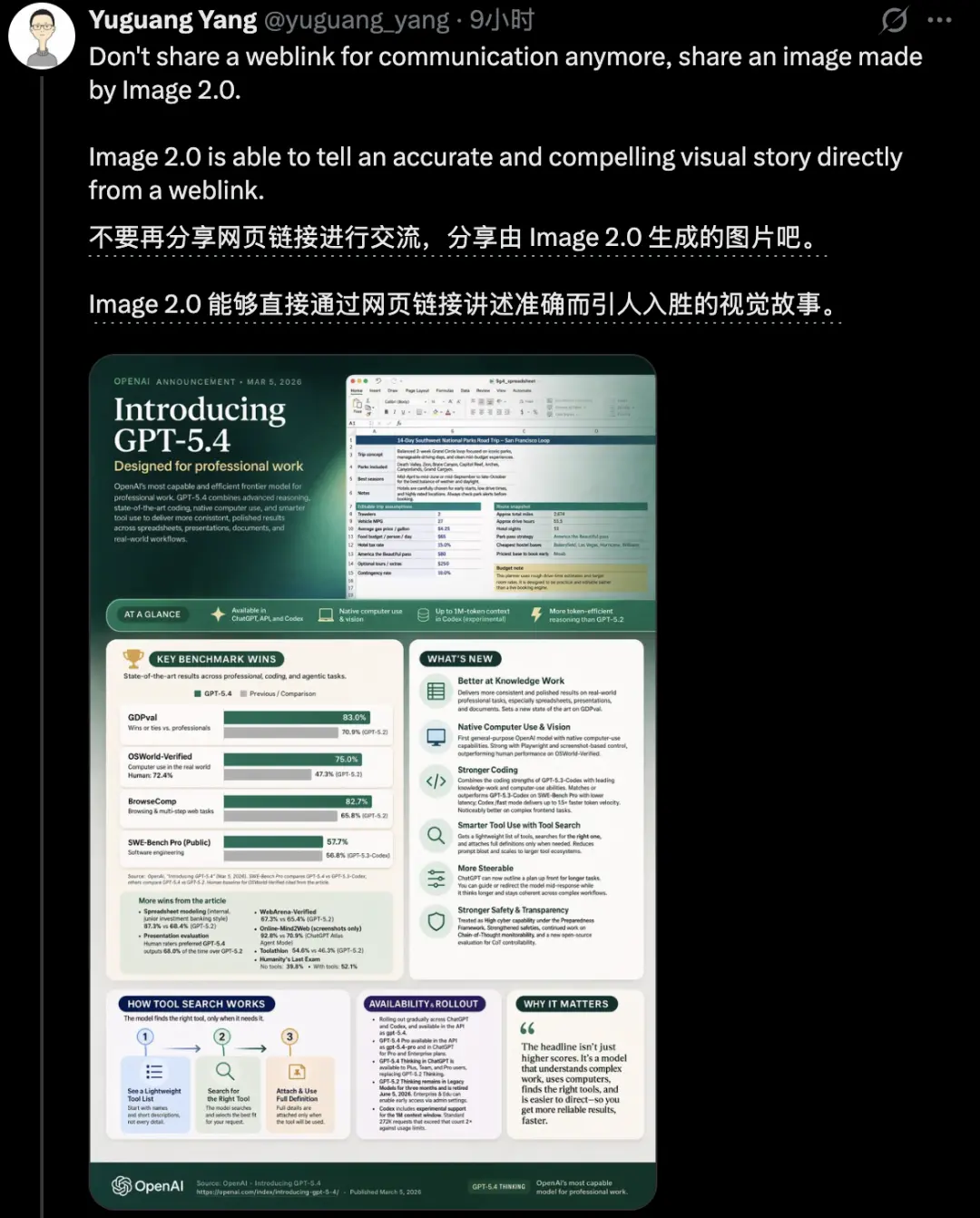

Yuguang Yang: Het genereren van complexe informatiegrafieken met hoge precisie

Yuguang Yang demonstreerde het genereren van infographics en PPT tijdens het lanceringsevenement van GPT Image 2.

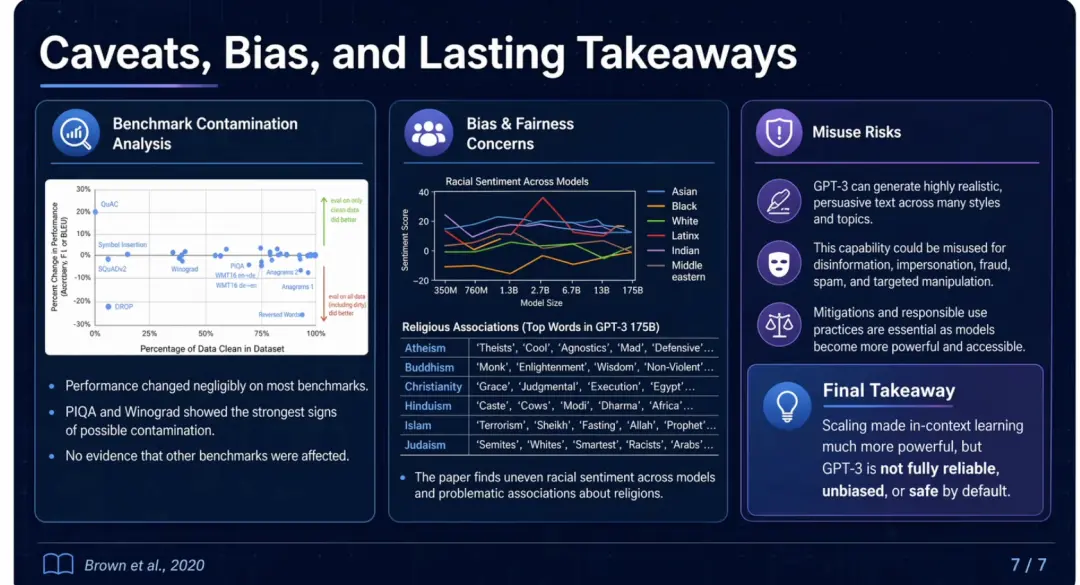

Sleep het volledige GPT-3-papier van 75 pagina's naar ChatGPT en genereer automatisch 7 dia's.

Zijn ervaring kan worden beschouwd als de rijkste onder de teamleden. Elke baan die hij aanneemt is grensoverschrijdend, maar ze zijn allemaal gericht op machinaal leren.

Hij studeerde techniek aan het Zhu Kezhen College van de Zhejiang Universiteit voor zijn bachelordiploma, en studeerde computationele chemische fysica en machinaal leren tijdens zijn Ph.D. aan de Johns Hopkins Universiteit.

Zijn eerste fulltimebaan was als kwantitatief analist. Terwijl hij als gastonderzoeker aan de Tsinghua Universiteit werkte, werkte Yaniu aan versterkende leer- en controle-algoritmen voor nanorobots.

Later deed hij Alexa-stemonderzoek bij Amazon.

Ik heb ook gewerkt aan het begrijpen en ophalen van Bing-zoekopdrachten en het begrijpen van documenten bij Microsoft.

Nadat hij begin 2025 bij OpenAI kwam werken, nam hij naast het genereren van afbeeldingen ook deel aan het ChatGPT-agentproject.

Hij introduceerde op zijn persoonlijke account de mogelijkheid om infographics te genereren met GPT Image 2, wat wetenschappelijke onderzoekers veel tijd kan besparen.

Ik herinner iedereen er ook herhaaldelijk aan dat je bij het maken van infographics niet vergeet de denkmodus te kiezen.

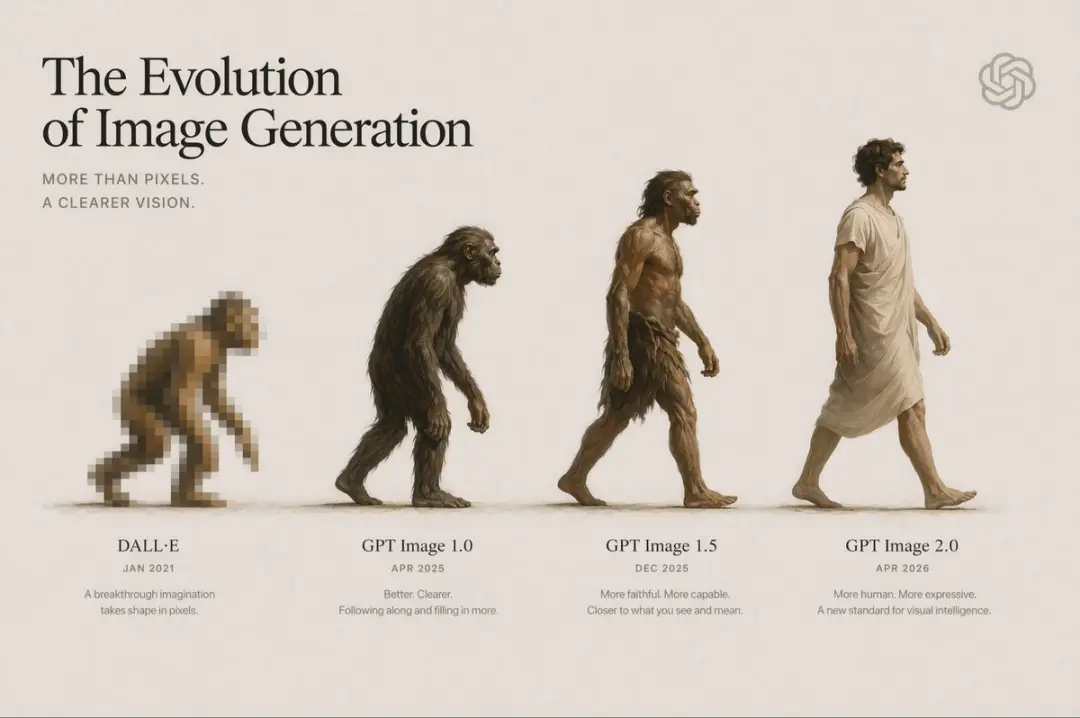

Van DALL-E naar GPT Afbeelding 2.0

Uit de zelfintroductie van teamlid Kenji Hata hebben we geleerd dat GPT Image 1.0 het onderdeel voor het genereren van afbeeldingen is van GPT-4o.

Er is één persoon die sinds DALL-E heeft deelgenomen aan het volledige onderzoek naar multimodale series van OpenAI.

Hij is Gabriel Goh, de leider van het GPT Image 2.0-team.

Sinds hij in 2019 bij OpenAI kwam, was zijn vroege onderzoek meer theoretisch, met de nadruk op interpreteerbaarheid, convexe optimalisatie, enz.

Vanaf DALL-E ben ik langzaam overgegaan op het genereren van afbeeldingen.

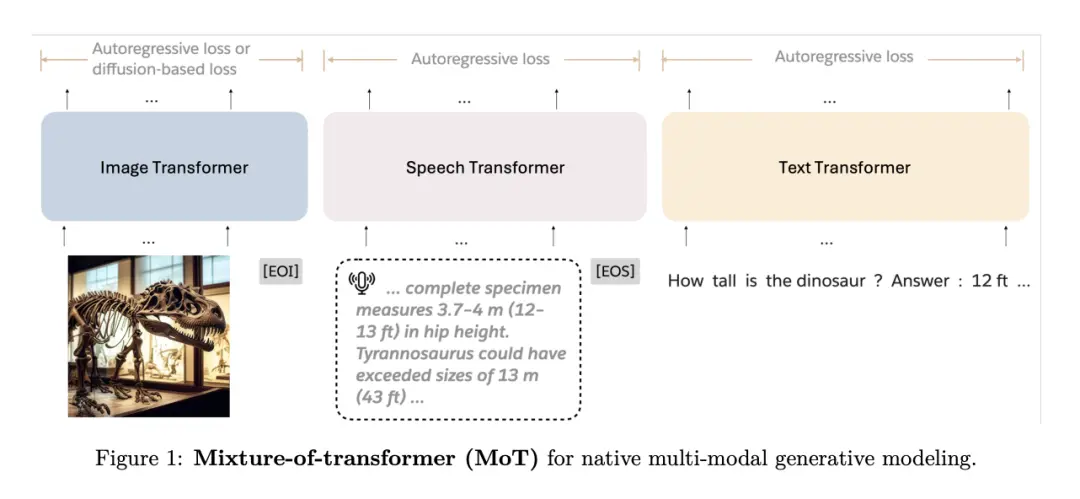

Bij het zien van het onderzoeks-cv van een ander teamlid, Weixin Liang, werd de technische achtergrond van GPT Image 2 onthuld.

Zijn representatieve werk tijdens zijn stage bij Meta, Mixture-of-Transformers, introduceerde modale ontkoppeling van MoE en ontkoppelde aandacht, waardoor de rekenkosten van de voortraining van multimodale modellen aanzienlijk werden verlaagd.

Hij studeerde af met een doctoraat aan Stanford en een bachelordiploma aan het Zhu Kezhen College van de Zhejiang Universiteit, maar hij was enkele jaren later dan Yuguang Yang.

Weixin Liang hebben, net als Chen Boyuan, allebei 25 jaar Ph.D. en sloot zich direct na zijn afstuderen aan bij OpenAI en werd al snel een kernlid van het team.

Andere GPT Image 2.0-teamleden zijn onder meer:

Ayaan Haque, die eerder bij Luma AI werkte, nam deel aan de training van Dream Machine, Luma’s basismodel voor het genereren van video’s.

Bing Liang werkt al meer dan vijf jaar bij Google en neemt deel aan Imagen3, Veo en Gemini Multimodal. In 2025 stapte hij over naar OpenAI om onderzoek naar beeldgeneratie te doen.

Mengchao Zhong is een alumnus van de Shanghai Jiao Tong Universiteit met een bachelordiploma en een masterdiploma van de Texas A&M University. Hij heeft gewerkt als software engineer bij Pinterest en Airtable, en is verantwoordelijk voor multimodale productengineering bij OpenAI.

Dibya Bhattacharjee, Yale University, IPhO bronzen medaille in 2015, hoogste score ter wereld in CIE A-Level Wiskunde en Biologie.

Kiwhan Song trad in oktober 2025 als laatste toe. Naast onderzoek is hij ook de stipte woordmeester in het team. Veel van de officiële demonstratiefoto's die je ziet, zijn van hem.

…

Vanaf de eerste DALL-E tot de huidige GPT Image 2.0 heeft dit team de problemen de een na de ander opgelost. Je kunt duidelijk tekenen, mooi tekenen en nauwkeurig tekenen.

Hoewel de talentstroom van OpenAI de afgelopen jaren groot is geweest, is OpenAI nog steeds een bedrijf dat talenten met verschillende persoonlijkheden kan blijven aantrekken, geen beperkingen oplegt aan majors, grensoverschrijdend onderzoek verwelkomt en gelooft in opkomend onderzoek van onderop.

Beginnend met een klein team, besteedt het bedrijf, nadat er doorbraken zijn bereikt, meer middelen totdat het de wereld verandert.

Nog één ding

Er was eens een tijd waarin GPT-4o-beeldgeneratie de wereld stormenderhand veroverde door avatars in Ghibli-stijl te imiteren.

Nu hebben de teamleden van GPT Image 2.0 allemaal hun avatars veranderd in deze vreemde nekstijl.

Dus wat zijn de aanwijzingen voor deze schilderstijl? Ook werden teamleden aangekondigd

Use my photo only for identity. Redraw me as a very simple surreal Japanese sticker-style caricature: long thin neck, small deadpan face, minimal black outline, flat light coloring, almost no shading, very few facial details, simplified hair shape, lots of white space, plain white background, slightly awkward and funny. Ultratall 1:3 image.

Referentielinks:

[1]https://x.com/gabeeegoooh/status/2046674385407512687?s=20

[2]https://venturebeat.com/technology/openais-chatgpt-images-2-0-is-here-and-it-does-multilingual-text-full-infographics-slides-maps-even-manga-schijnbaar-flawlessly